| 無料 | 個人・企業 | 当初は個人は無料でしたが企業も無料に変更されている。 |

| 有料(問い合わせ) | 企業 | TeamsとEnterpriseが有るようだが、詳しくは不明である。 |

| 名称 | URL | 概要 |

| LM Studio | [https://lmstudio.ai](https://lmstudio.ai) | Element Labs, Inc. |

| Llama 4 | [https://www.llama.com/models/llama-4/](https://www.llama.com/models/llama-4/) | 2025年4月、Meta社、マルチモーダル機能と言うテキスト/画像/動画を処理 |

| Mistral AI | [https://mistral.ai](https://mistral.ai) | 2023年、オープンソース型、複数のAIモデルを組み合わせて処理 |

| Qwen 3 | [https://qwen.ai/home](https://qwen.ai/home) | 2025年、アリババクラウド、オープンソース |

| Gemma 4 | [https://ai.google.dev/gemma/docs/core/model\_card\_4?hl=ja](https://ai.google.dev/gemma/docs/core/model_card_4?hl=ja) | 2024年、Google DeepMind社、AIオープン化戦略の一環で提供 |

| DeepSeek | [https://www.deepseek.com](https://www.deepseek.com) | 2024年、DeepSeek社 |

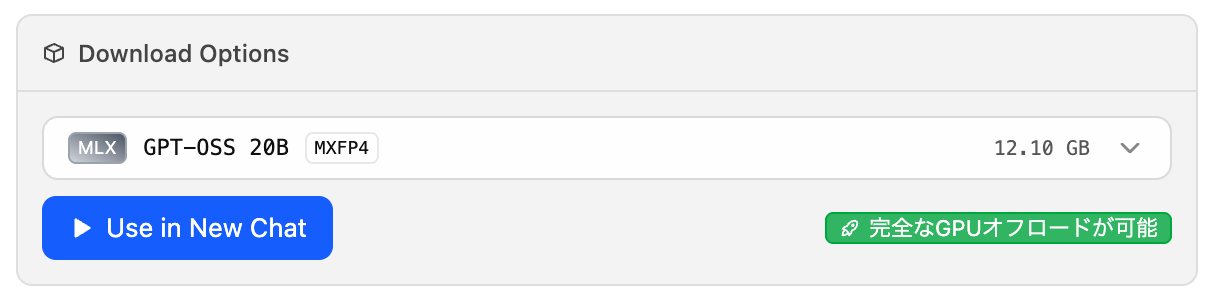

| GPT-OSS | [オープンモデル (gpt-oss)](https://help.openai.com/ja-jp/collections/14446186-open-models-gpt-oss) | 2025年8月、OpenAI社、オープンソースGPT系 |

| Phi-4 | [https://azure.microsoft.com/ja-jp/products/phi](https://azure.microsoft.com/ja-jp/products/phi) | Microsoft社、小型言語モデル |

| TinyLlama | [https://github.com/jzhang38/TinyLlama](https://github.com/jzhang38/TinyLlama) | 2024年1月、オープンソース(Apache 2.0)、エッジデバイス活用 |

| LM Studio | バージョン0.4.9+1 (0.4.9+1) |

| 2026-04-12 からはUpdate: バージョン0.4.11+1 (0.4.11+1) | |

| MacBookPro 14 inch | CPU: Apple Silicon M1 Max |

| RAM: 32 GB | |

| SSD: 1 TB | |

| macOS: Tahoe 26.4 | |

| Xcode: 26.4 (APIテスト用) | |

| MacBookPro 16 inch | CPU: Apple Silicon M2 Max |

| RAM: 96 GB | |

| SSD: 8 TB | |

| macOS: Tahoe 26.4 | |

| Xcode: 26.4 (APIテスト用) | |

| Mac mini | CPU: Apple Silicon M2 |

| RAM: 24 GB | |

| SSD: 255 GB | |

| macOS: Sequoia 15.7.1(24G231) |

| OS | macOS 14.0(Sonoma)以降 Apple Silicon(M1 / M2 / M3 / M4)のみ。 (Intel Macには未対応 [こちらWebの情報](https://github.com/lmstudio-ai/lmstudio-bug-tracker/issues/9)を参照してくたせさい。) |

| RAM | 16GB以上(8GBでも起動するがモデルは最小モデルを推薦) |

| GPU | Apple Siliconでは、CPUとGPUのメモリを共有 |

| OS | x64およびARM(Snapdragon X Elite)ベースのシステム CPU: x64時はAVX2命令セットのサポートが必要 |

| RAM | 16GB以上のRAMを推奨 |

| GPU | 4GB以上の専用VRAMを推奨 |

| OS | x64およびARM64(aarch64)ベースのシステム Ubuntu 20.04以降が必要(Ubuntu 22より新しいバージョンについては、十分なテストが行われていません。) x64環境では、LM StudioはデフォルトでAVX2に対応 |

| RAM | 特に記述無し |

| GPU | 特に記述無し |

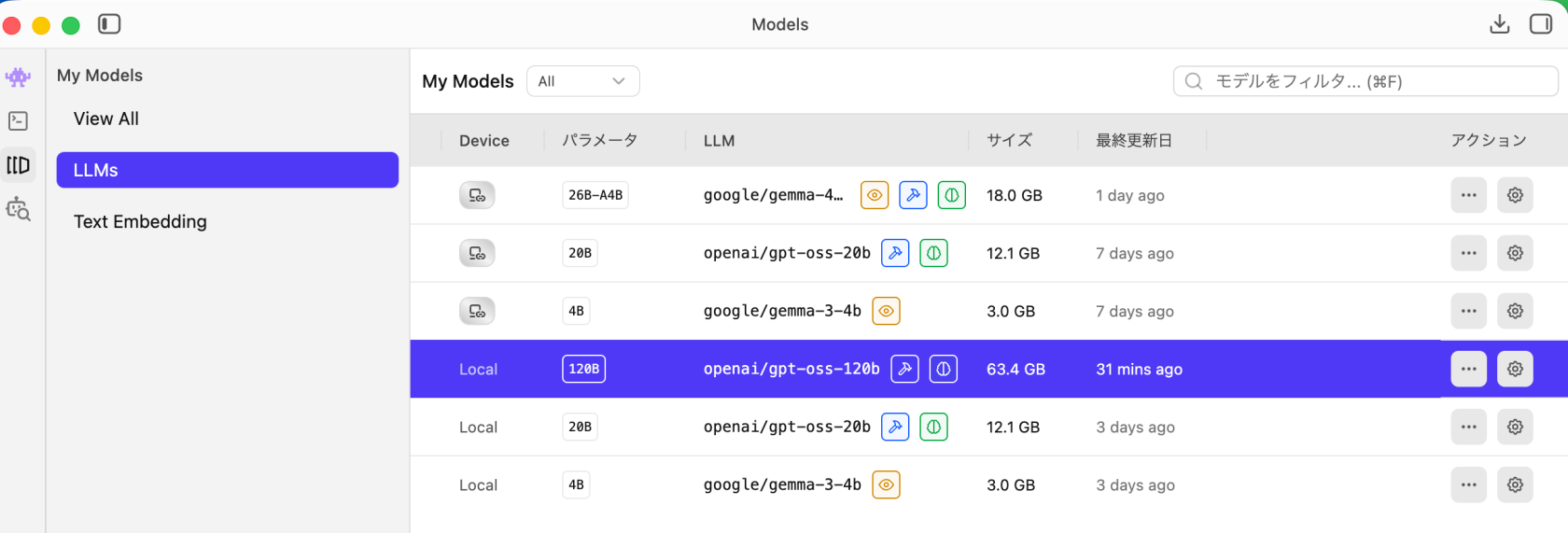

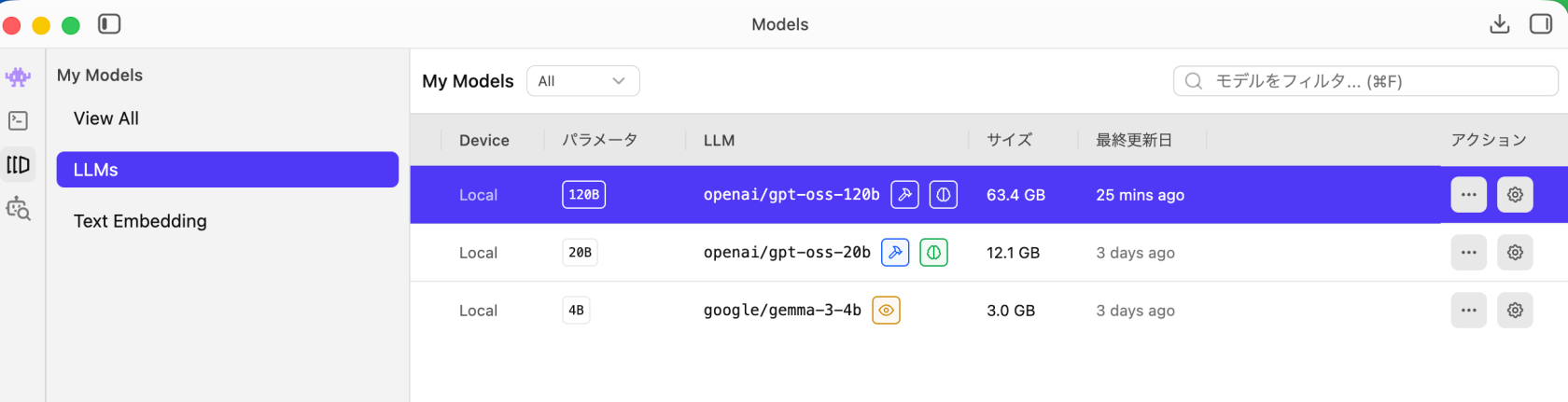

120Bとか20Bは何? モデルの「パラメータ数(重みの数)」です、20Bは約 200億パラメータ、120Bは 約 1200億パラメータとなります。

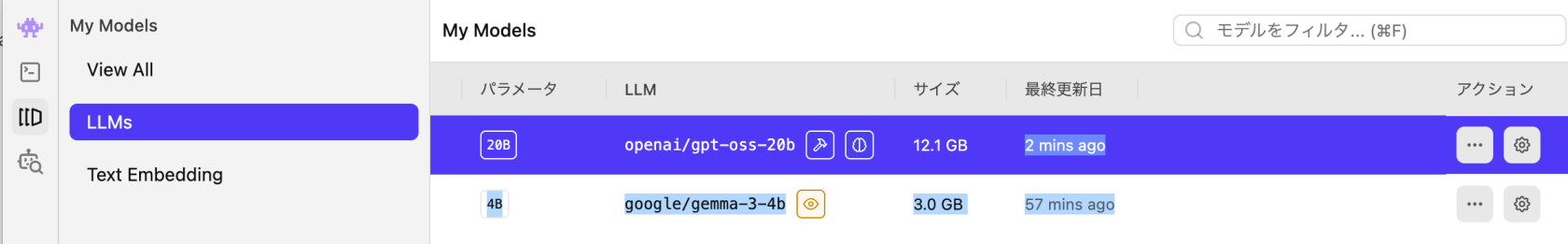

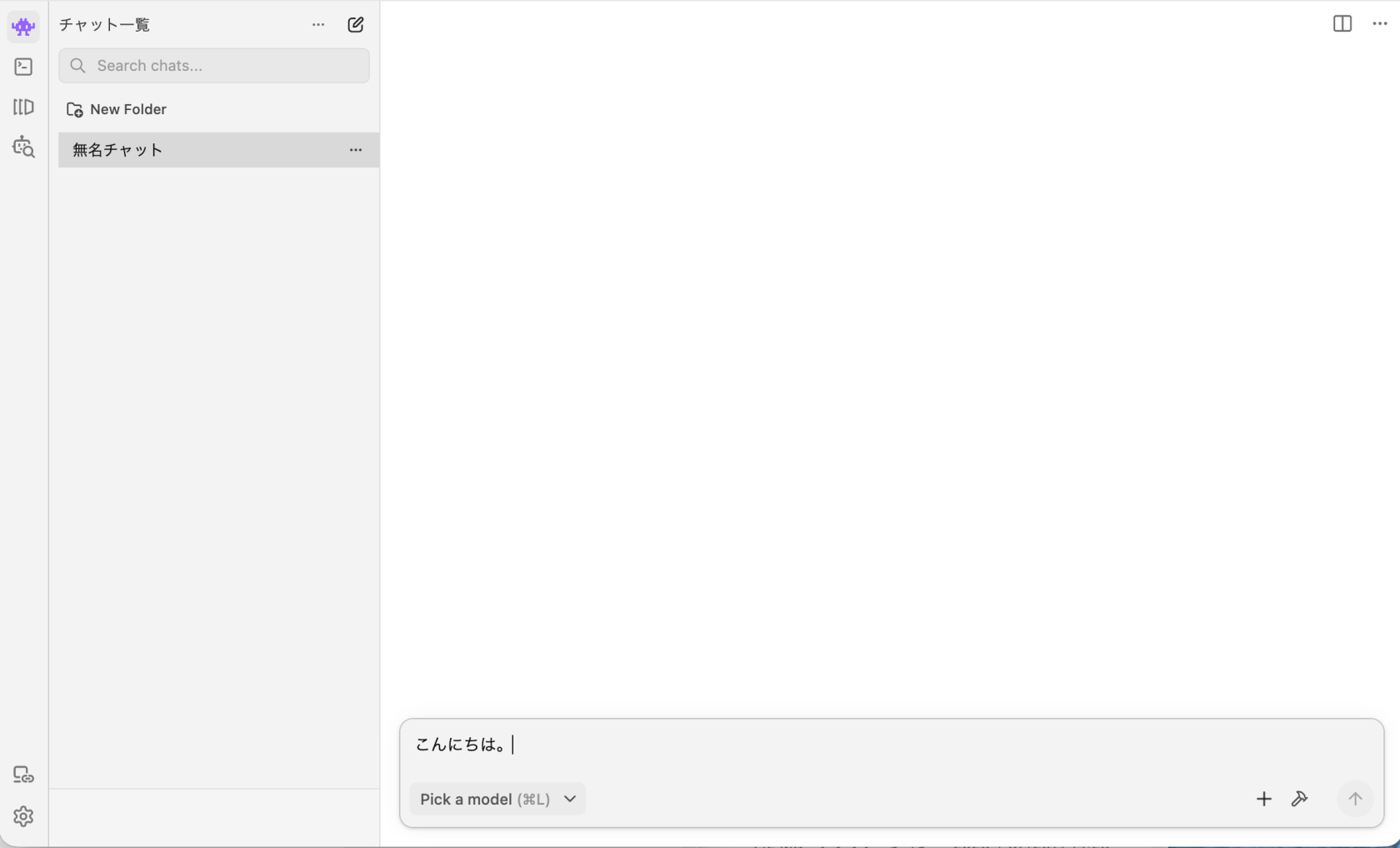

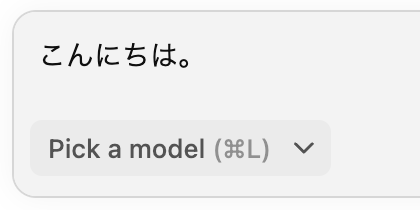

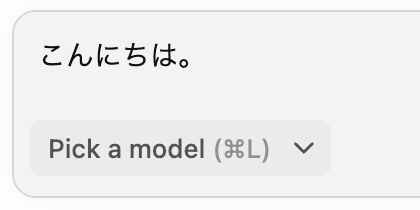

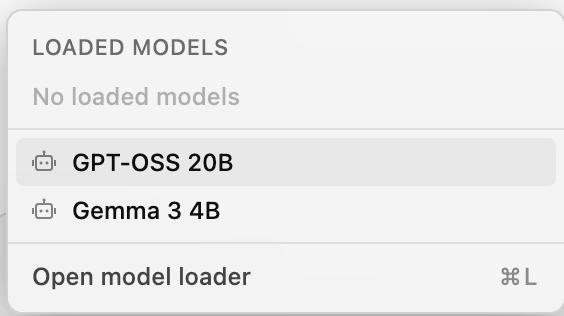

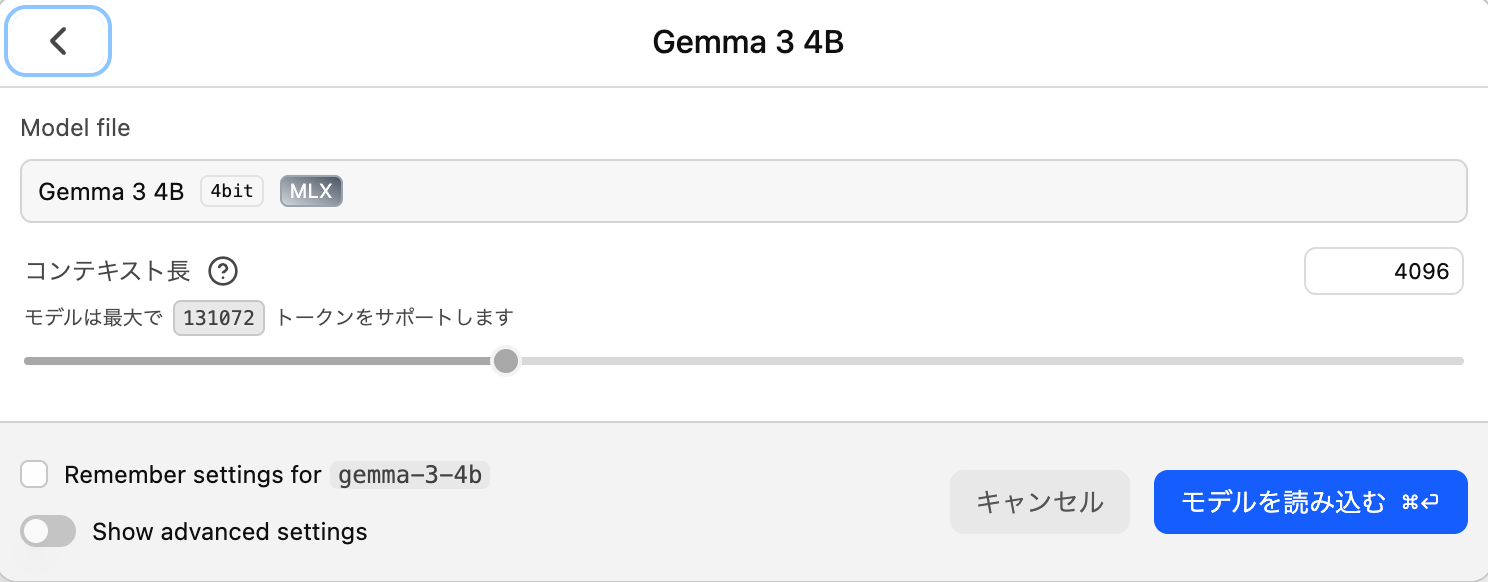

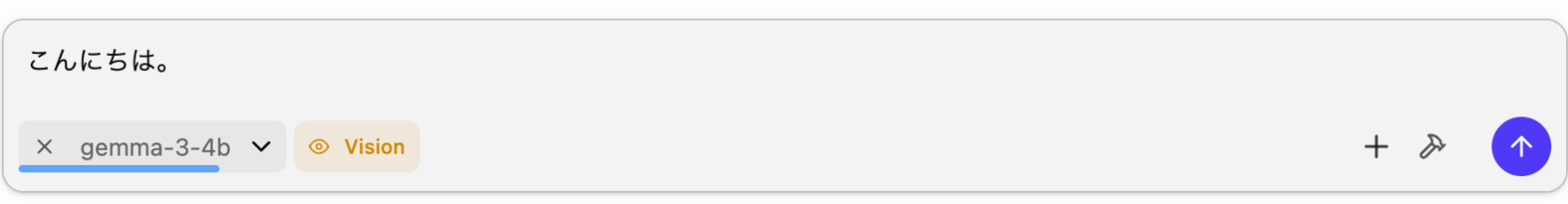

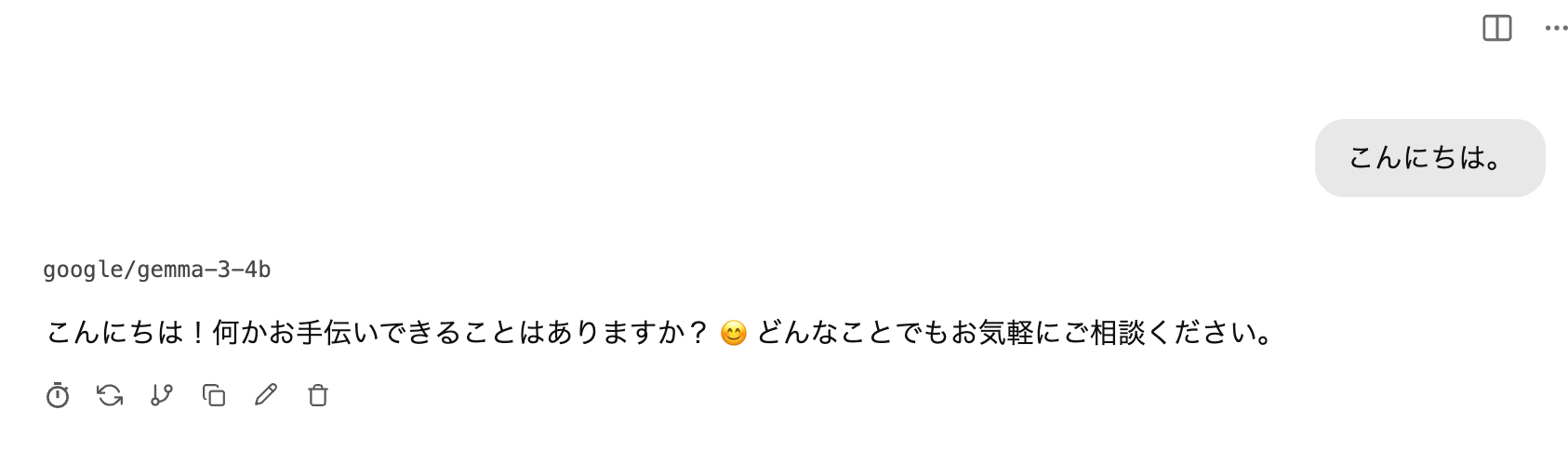

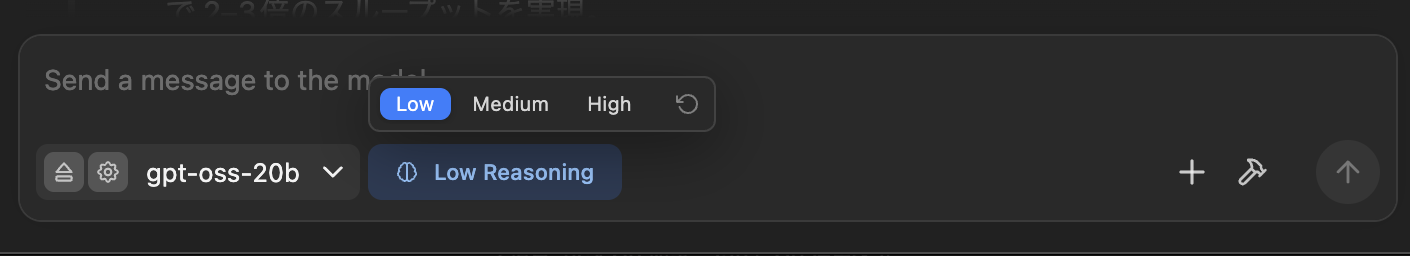

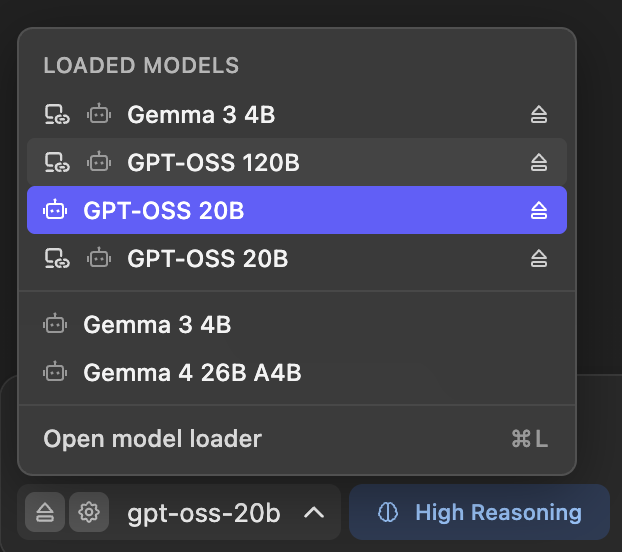

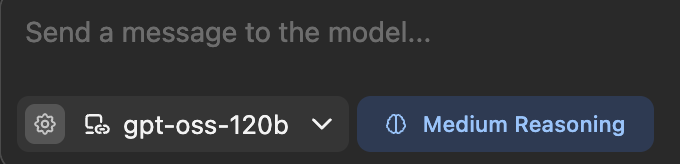

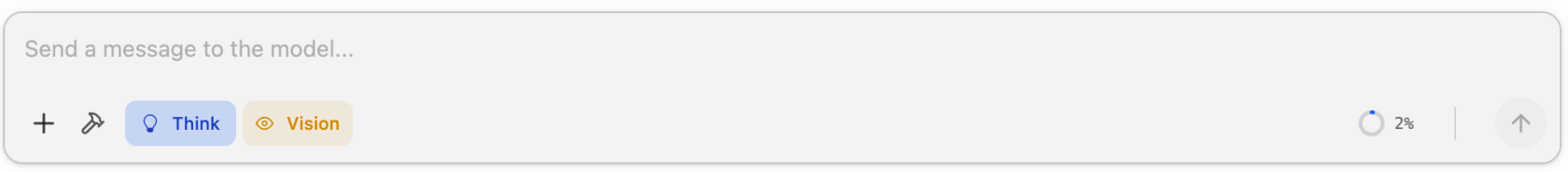

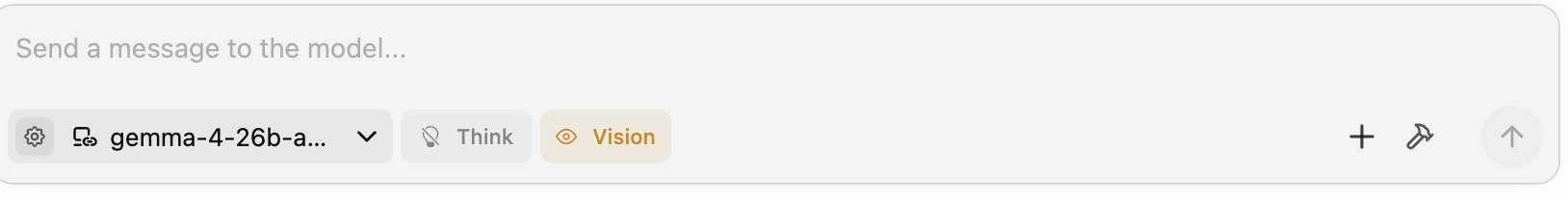

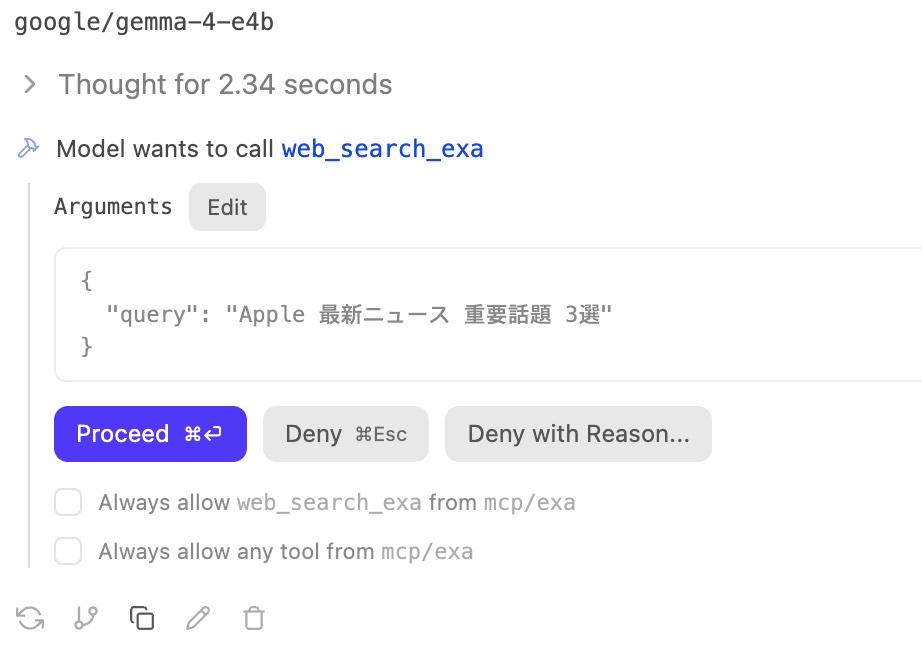

ダウンロード完了 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-08-2-56-23.png) 再び、My Modelsを確認するとGPTが追加されています。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-08-2-58-32.png) # 導入テスト 「LM Studioのテスト」関係の導入時の簡単なテスト結果を記述しています。 # 最初のチャット ##### 最初のチャット 画面中央の「New chat」をクリックして最初のチャットを始めます。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-08-3-03-41.png) チャット枠が開くのでメッセージを入力します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-08-3-05-42.png) [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-08-3-08-06.png) 入力後、送信ボタン(上矢印)が有効になりません。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-08-3-06-46.png) チャットの「Pick a model」をクリックして、モデルをロードしてください。モデルがロードされていなかったので送信ボタンが有効になりませんでした。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/iHT2026-04-08-3-08-06.png) 今回は「Gemma 3 4B」の軽量モデルを選択します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/Mpy2026-04-08-3-08-23.png) モデルの読み込み用のダイアログが表示されるので「モデルを読み込む」ボタンで読み込んでください。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/STP2026-04-08-3-08-40.png) 読み込みが完了したら送信ボタンでメッセージを送信してください。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-08-3-08-59.png) 返答が得られます。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-08-3-15-10.png) この段階でのmacOSのメモリ使用量をみてみましょう。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-08-3-17-29.png) # 推論強度の設定 #### Reasoning(推論強度)設定 チャット画面左下の「Reasoning」でモデルに対して推論(考える時間)の強度を指定出来ます。 Reasoningは3つの指定が出来ます。 - Low - Medium - High [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-08-4-24-45.png) ##### Low指定 短時間で即答できる軽い推論(軽いQ&Aとかチャット)を想定しています。負荷は軽いです。 ##### Medium指定 回答スピードと質問内容のバランスを取ったモードと言われてています。回答はLowに比べて遅くなります。 ##### High指定 推論は一番深く時間が掛かります。複雑な内容を処理する事を目的にしています。 #### 設定変更の結果サンブル 設定を3種類変更して得られるサンブルの回答の具体例を記述します。 使用したモデルは「GPT-OSS 20B」です。 また、質問内容は全て同一で「AIを実行する最適なmacの購入構成を出して下さい。」です。| Reasoning設定 | 応答までの時間 |

| Low | 約1-2秒 |

| Medium | 約4秒 |

| High | 約27秒 |

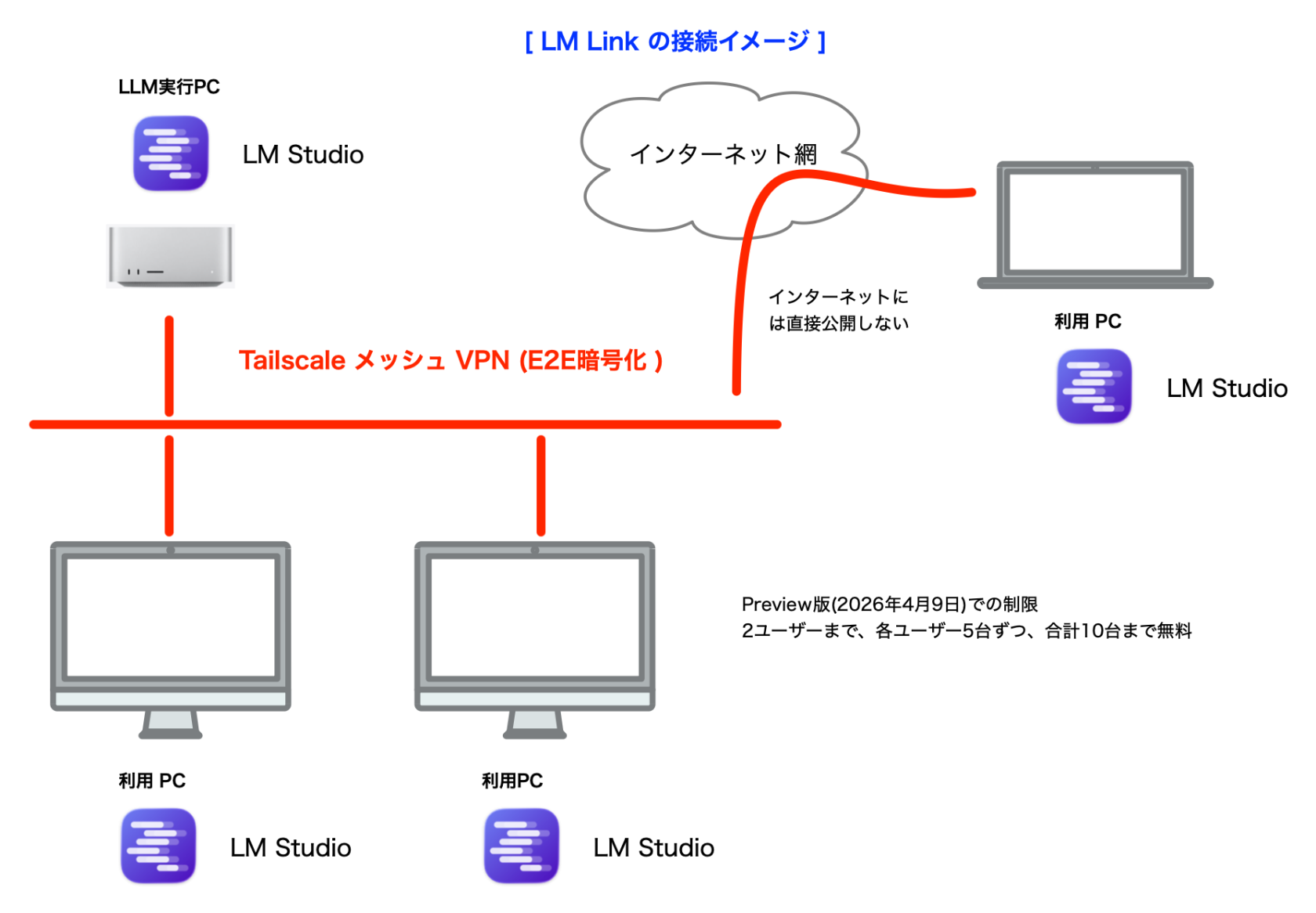

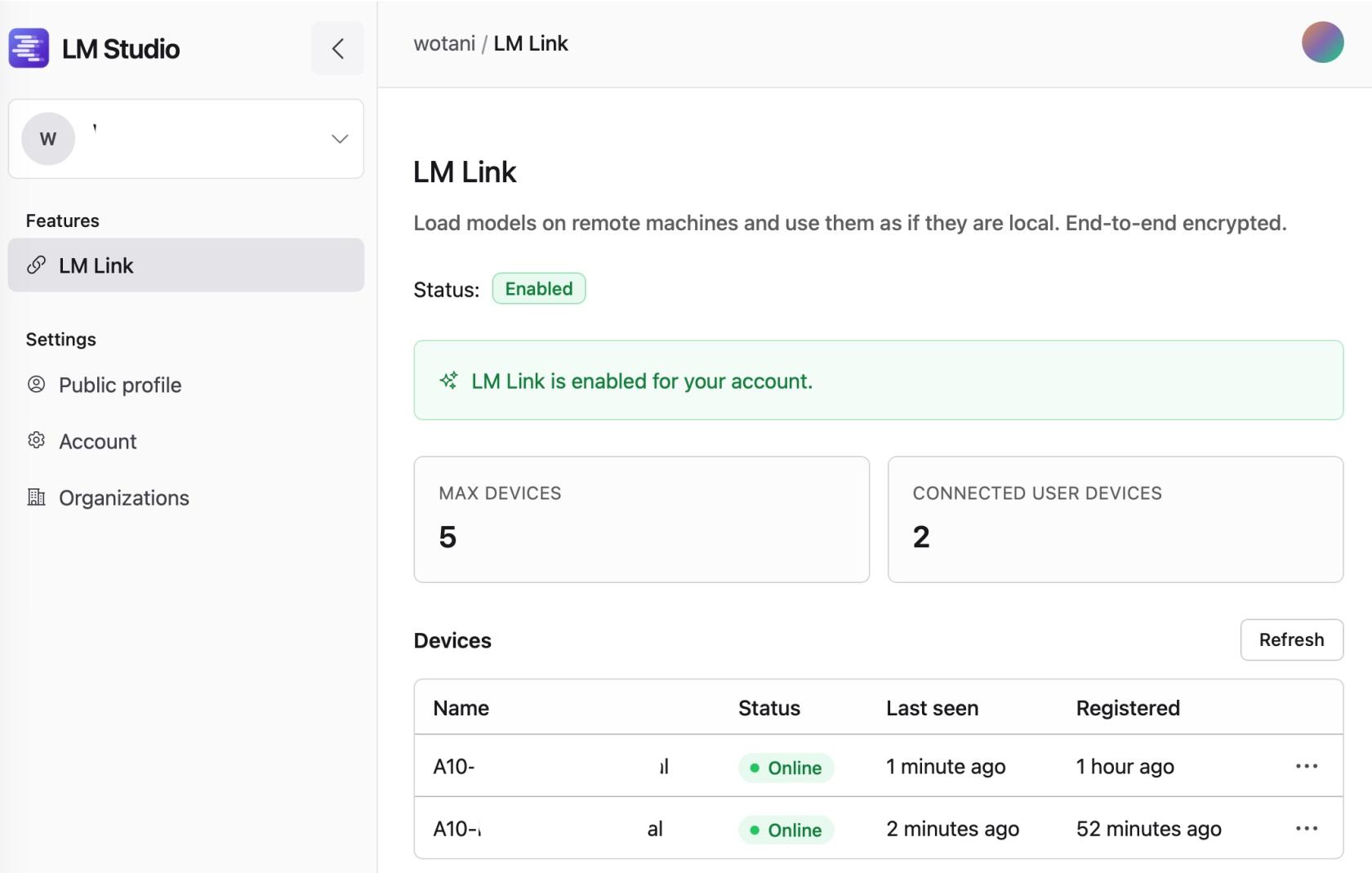

2026年4月9日現在 LM Linkは現時点では、2ユーザーまで、各ユーザー5台ずつ、合計10台まで無料で利用できます。追加のユーザー数やデバイス数に対する有料プランはまだ導入されていませんが、LM LinkがPreview期間を終了した後に提供される予定のようです。

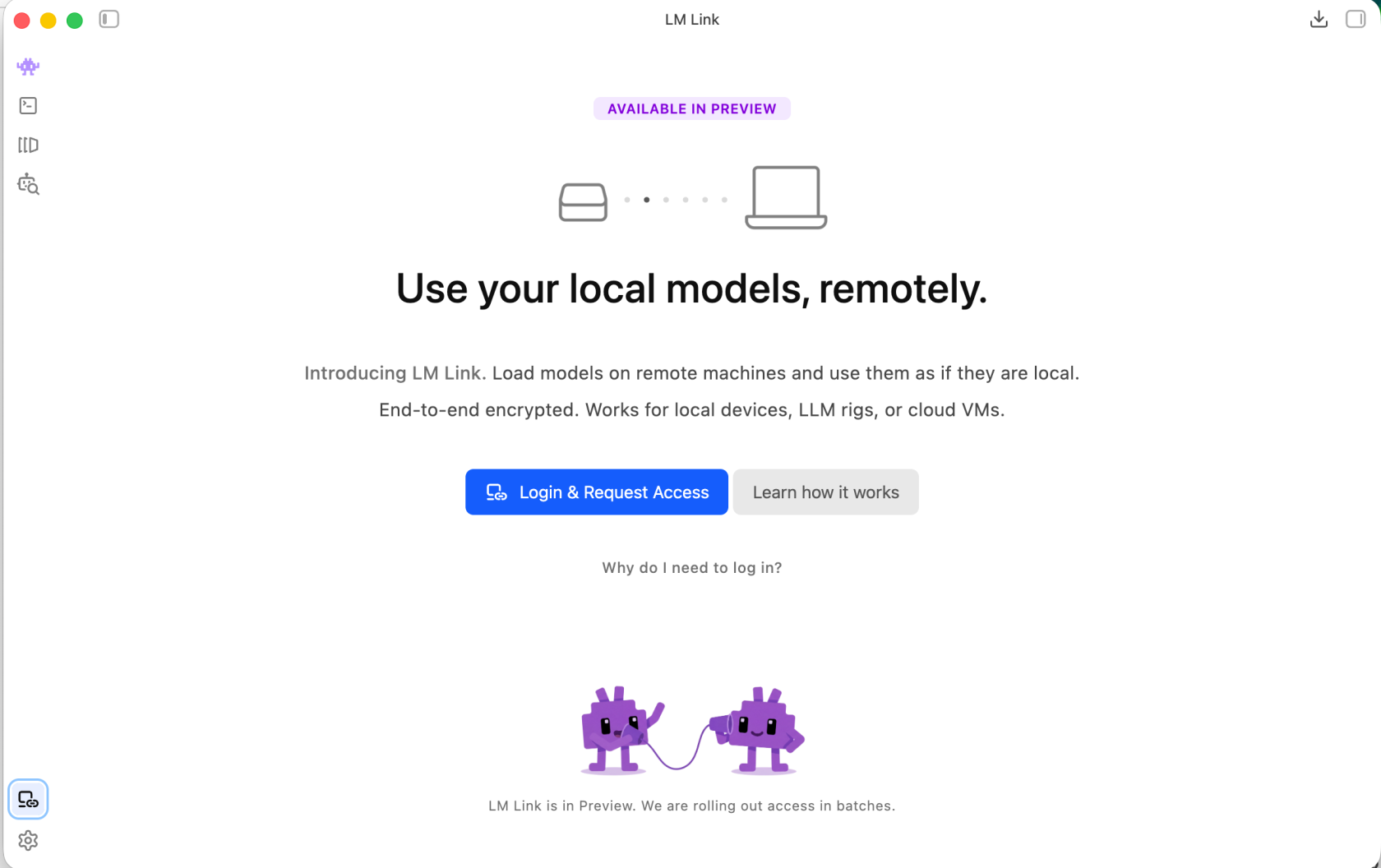

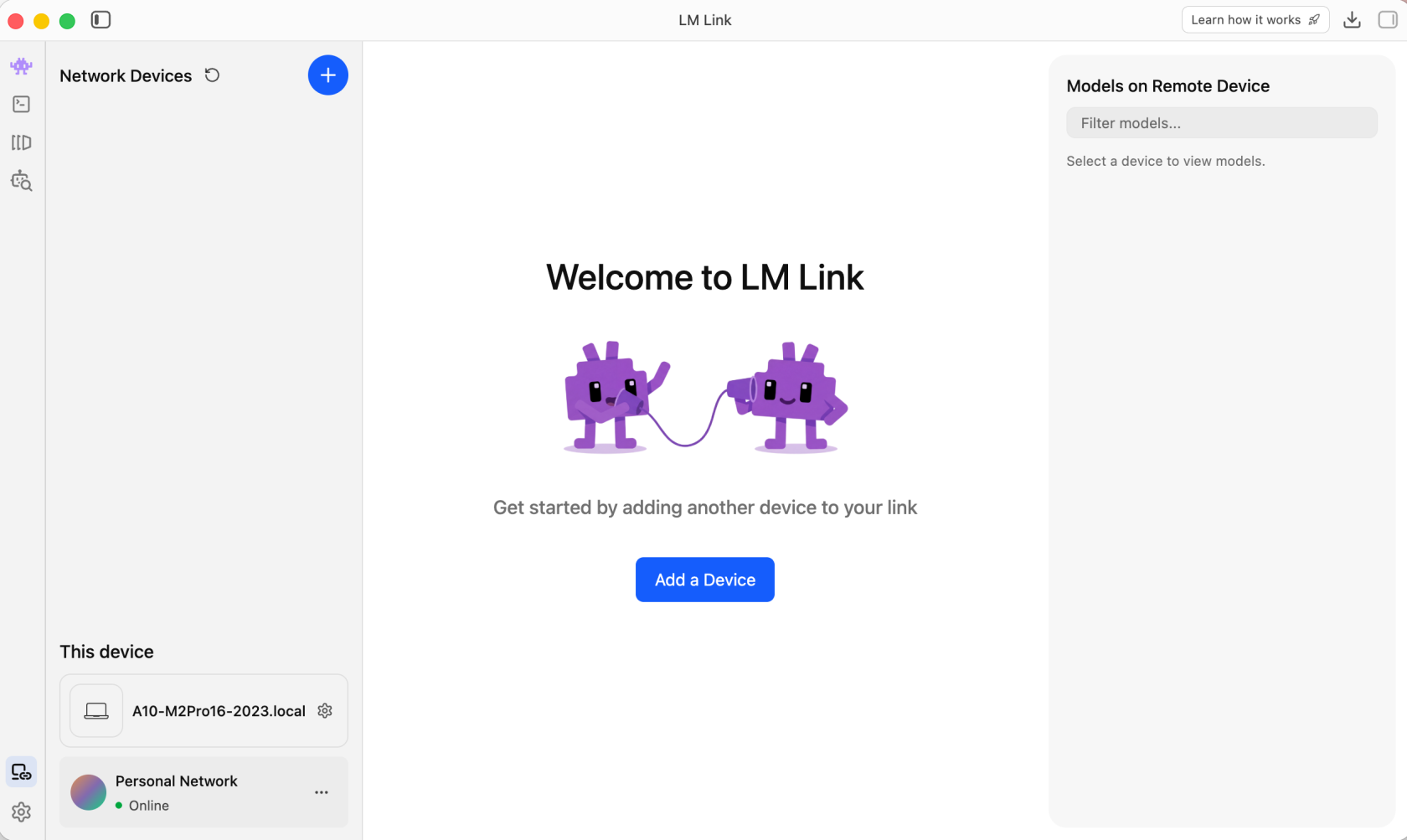

##### LM Linkの接続イメージ [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/lm-link.png) # LM Linkの設定 ##### LM Linkの設定-アカウント登録 「LM Studio」を使用したいPCにインストールします。LLM Linkでは、LM Studio アカウントが必要となります。

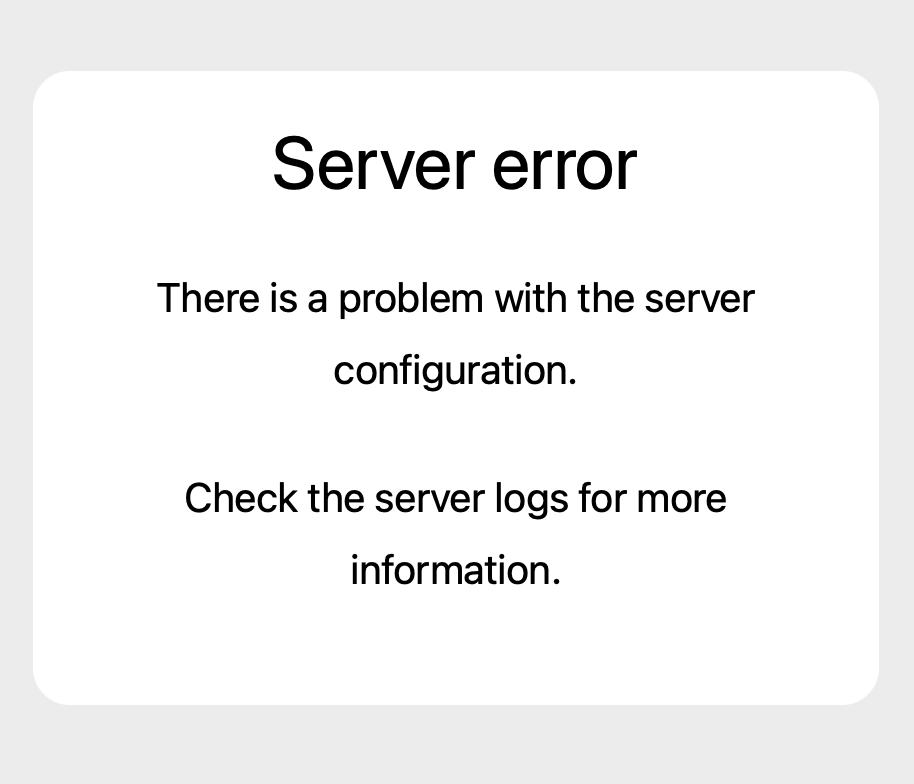

LM Studio Hubにユーザー/デバイスを登録時にサーバーが失敗したりエラーを出したりと非常に不安定です。この文書は何度もトライしたり1日待ったりと時間がかかりました。安定動作になることを期待しています。2026年4月10日

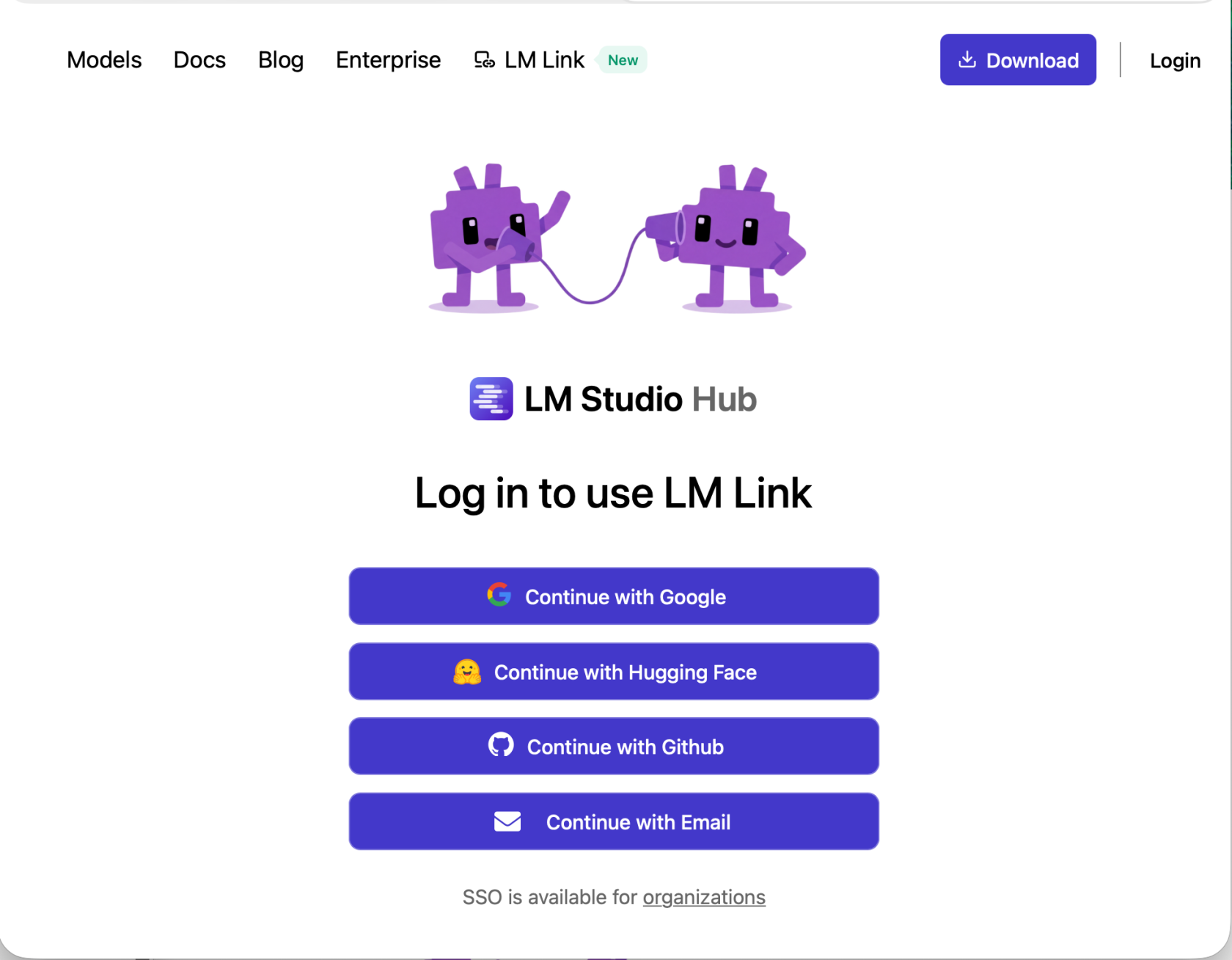

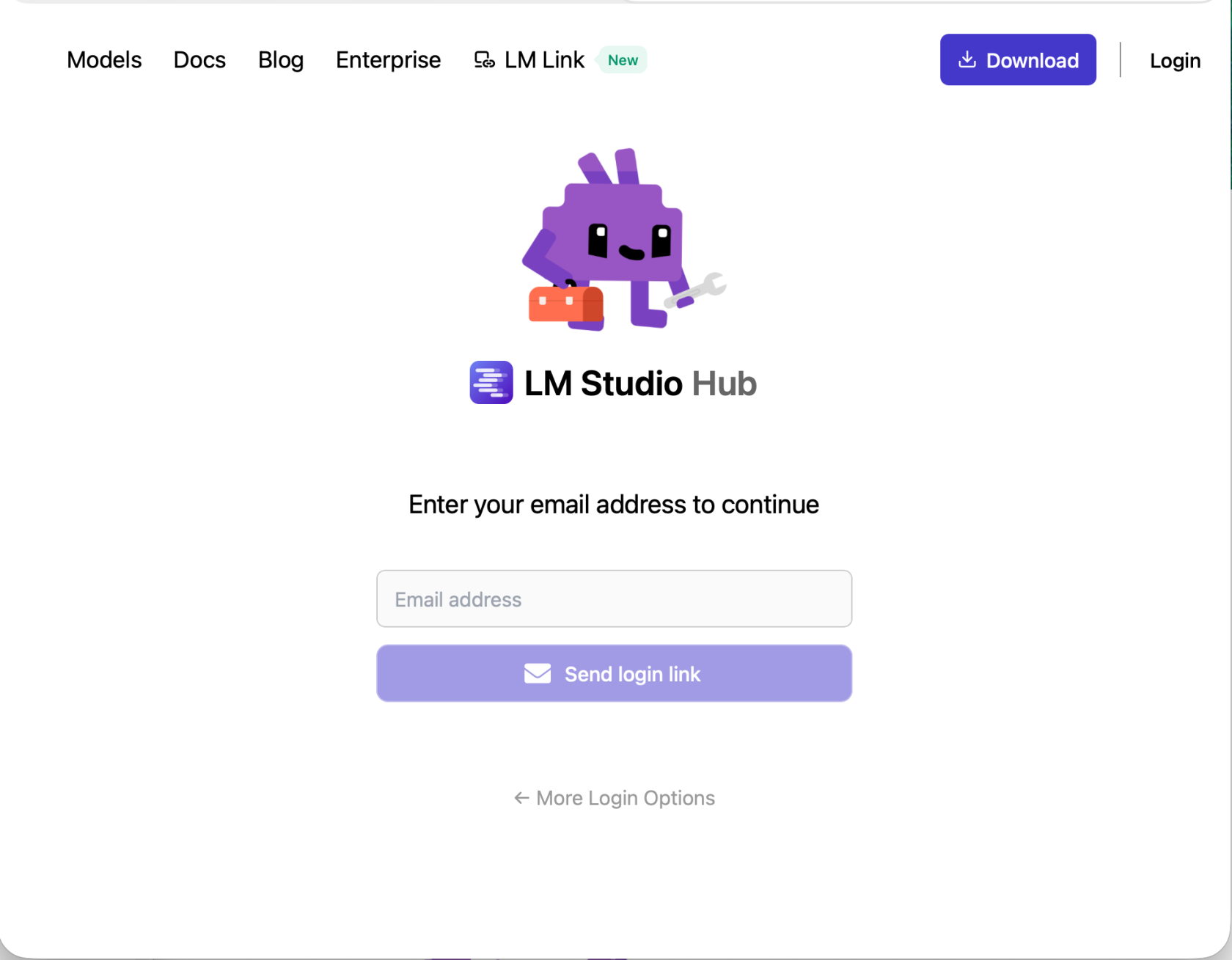

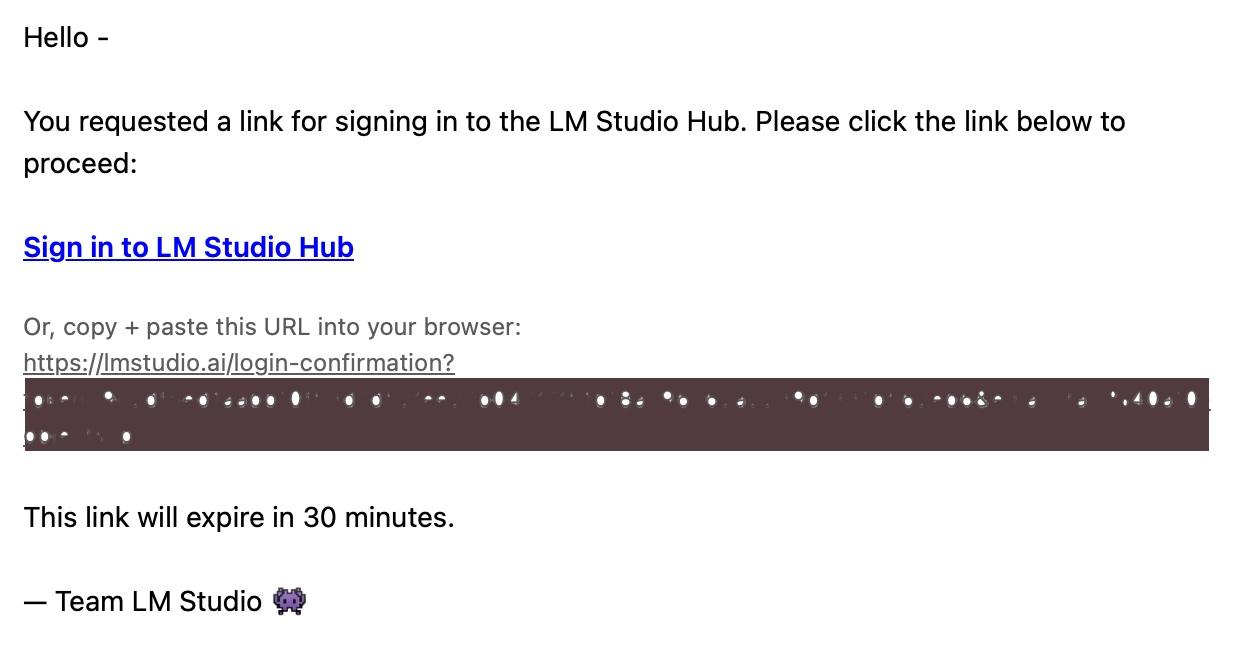

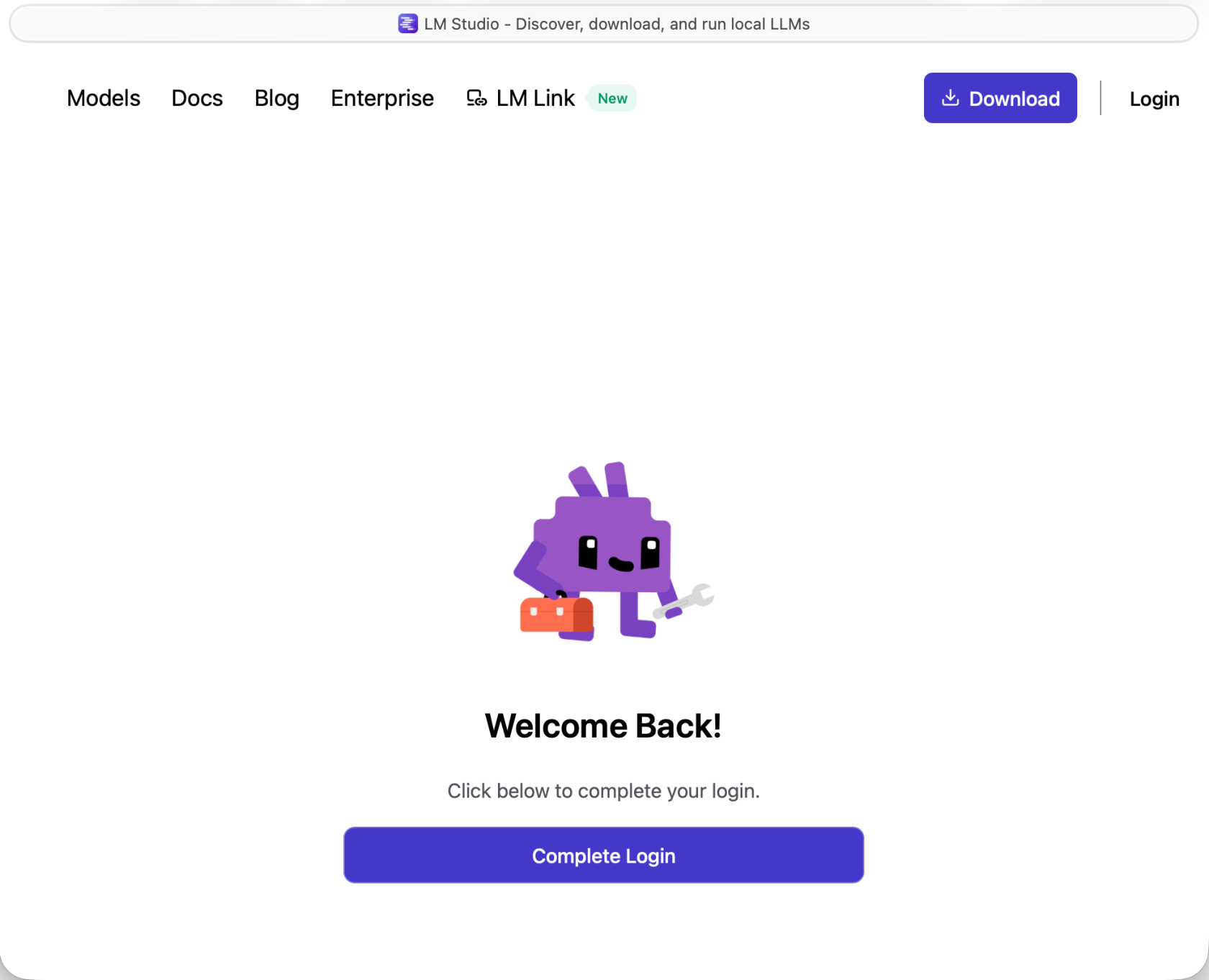

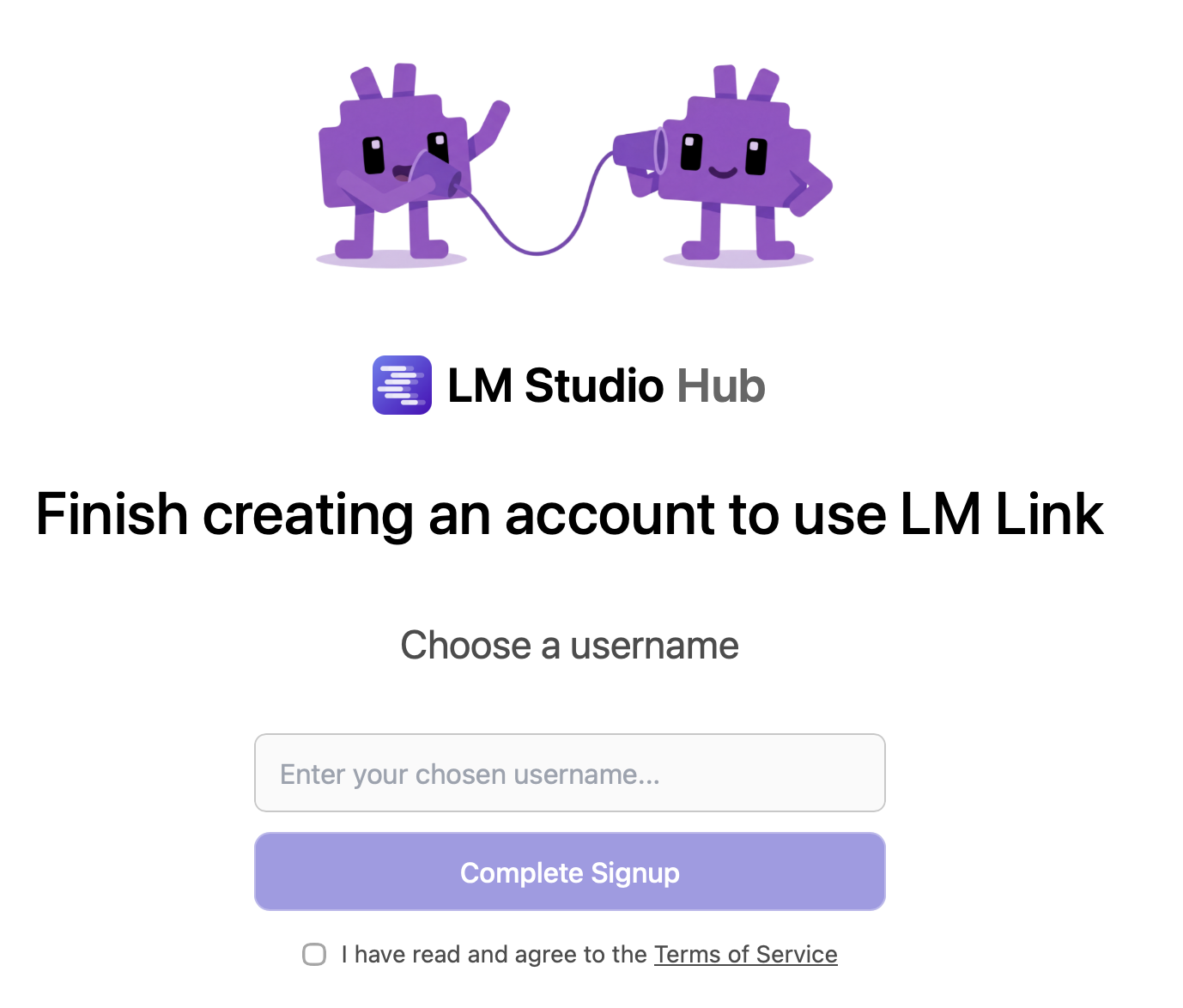

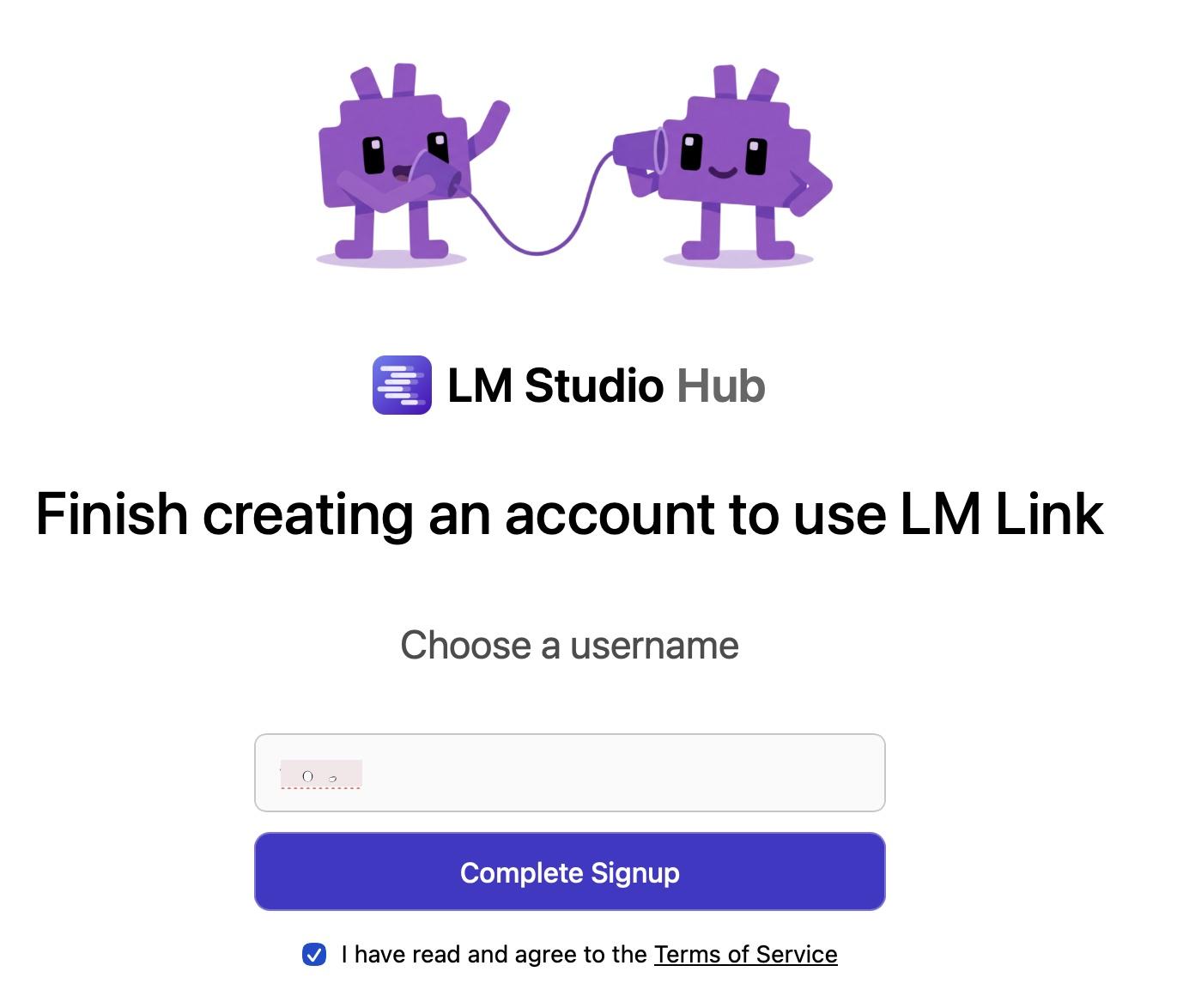

「LM Studio」の画面左下のアイコンをクリックして設定画面を表示します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-1-25-47.png) 「Login & Request Access」ボタンを押して、LM Studio アカウントなどを登録します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-1-25-56.png) 「LM Studio」との登録ページが表示されるのでいずれかの方法で登録します。今回は「Email」で登録します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-1-32-53.png) 電子メールアドレスを入力して「Send login link」ボタンを押します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-1-34-46.png) [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-1-35-13.png) 電子メールが届くので「Sign in to LM Studio Hub」のリンクをクリックするかリンク用のURLをコピーしてWebブラウザで開きます。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-1-37-08.jpg) 「Complete Login」ボタンを押して完了します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-1-37-53.png) usernameを登録する画面になります。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-23-03-11.png)注意: アカウント登録時に以下の様なサーバーエラーが出るときが有ります。その場合には、しばらく待って再度最初から登録操作を行います。

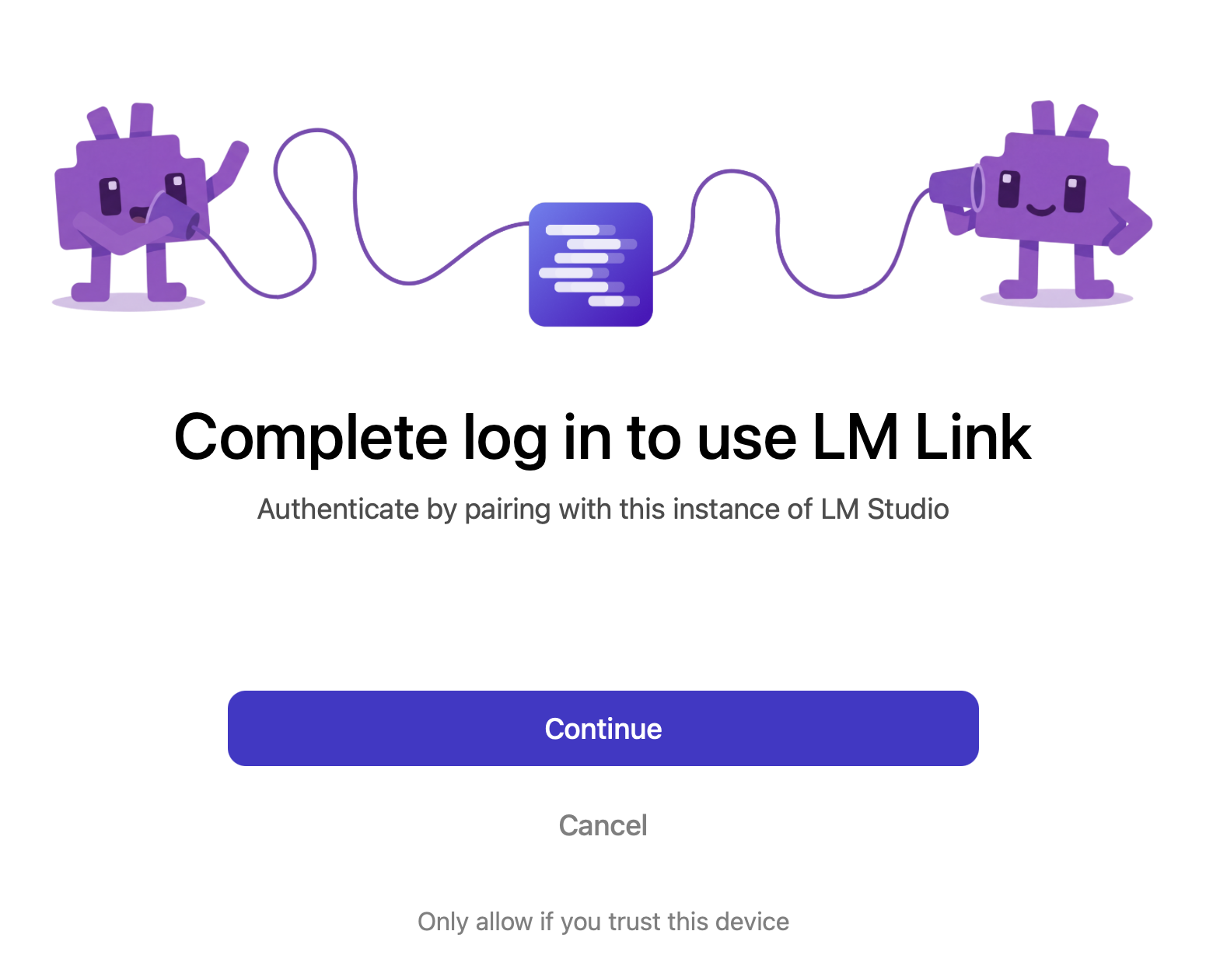

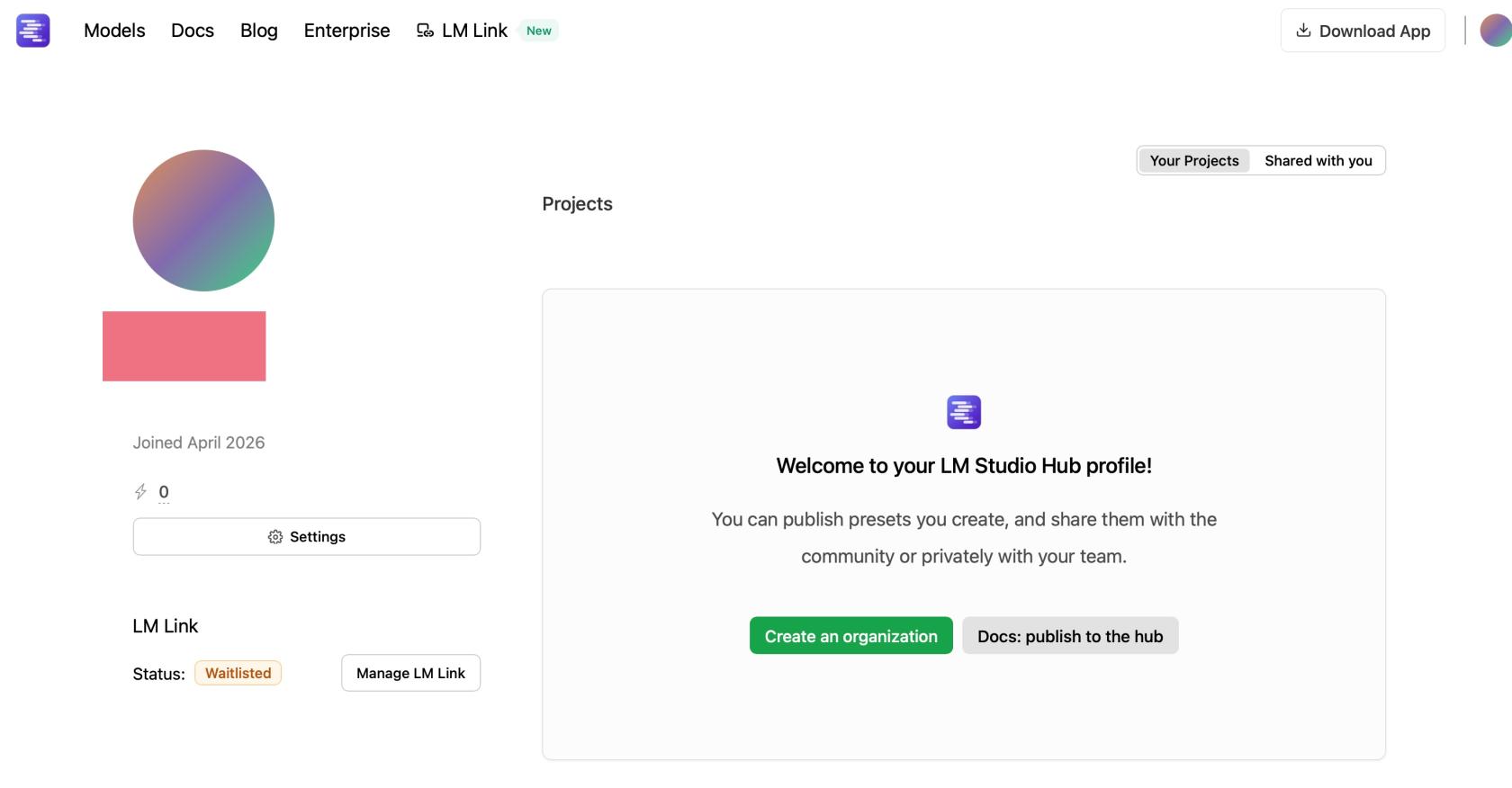

[](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-2-14-15.png) ユーザー名を入力してチェックを入れて「Complate Signup」ボタンを押します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-23-04-33.jpg) 更に「Cintinue」ボタンを押して、Projects管理画面を表示します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-23-04-48.png) ##### Projects画面 Projects画面です。特に何もしません。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-23-05-40.jpg) ここまでで、登録したメールアドレスににメッセージが届きます。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-23-20-06.png) [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-23-20-21.png) ##### 「LM Studio」アプリの画面 今回はLLM実行PCと利用PCの2台を同じアカウントで登録しています。画面はローカルネットワークでの接続です。

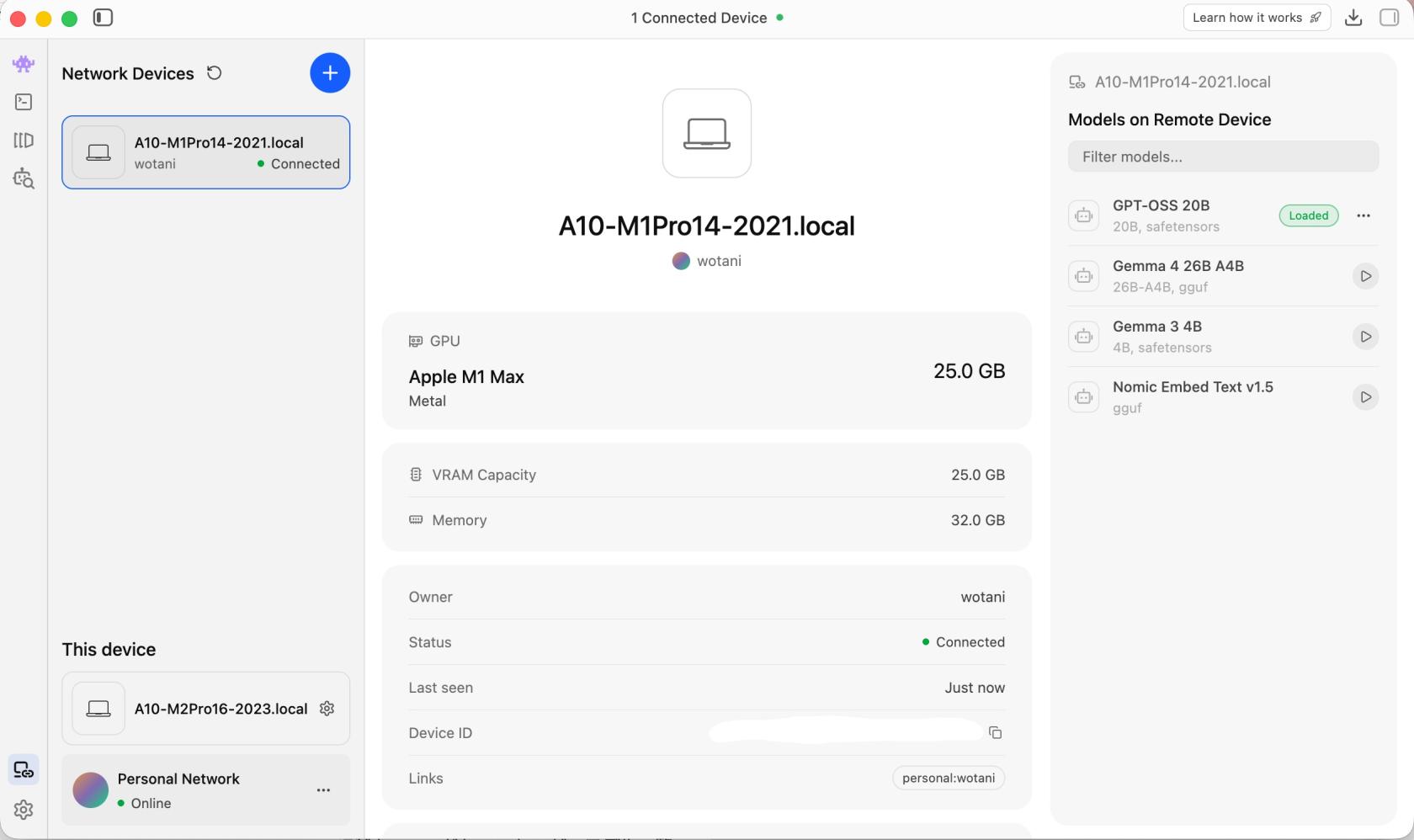

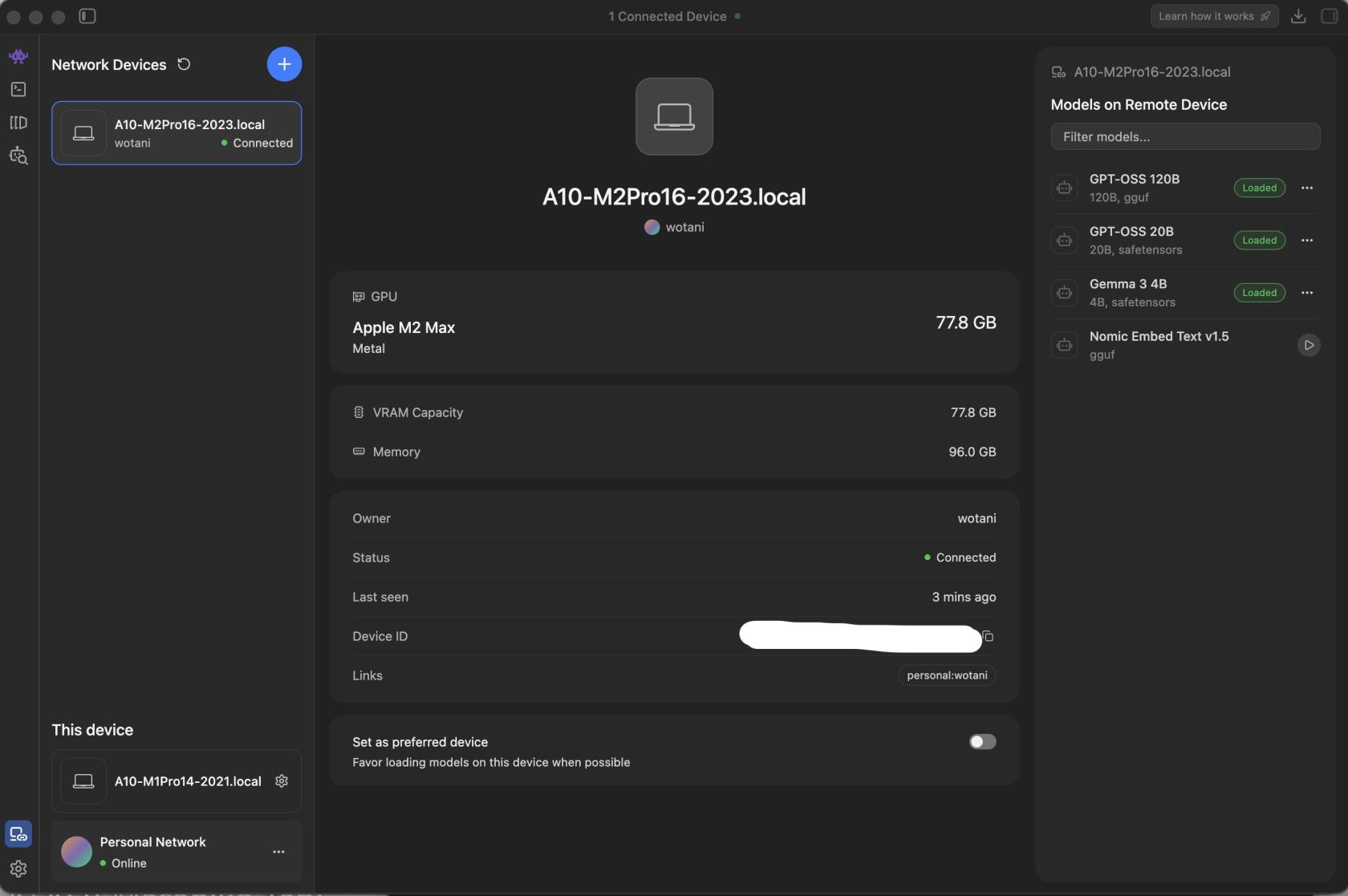

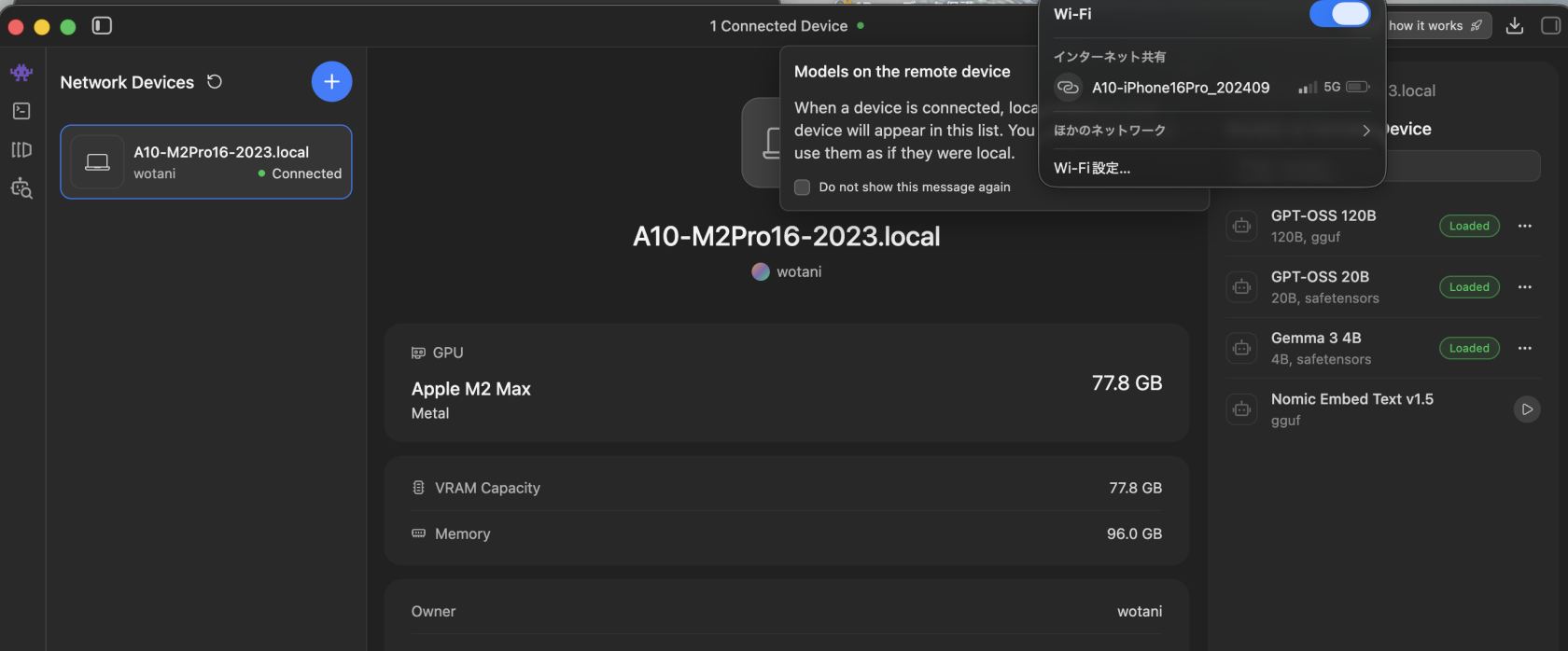

[](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-23-25-03.png) 画面左下には「This decice」として表示されます。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-23-25-18.png) 利用PCを登録するとLLM実行PC画面にに追加されます。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-23-33-11.jpg) 利用PC側の画面にはLLM実行PCが追加されます。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-09-23-39-36.jpg) それぞれのPC側からは、相手のPCの状態が見えます。 - Remote Deviceのモデル一覧と状態 - マシンの環境 # ローカルアクセス ##### ローカルネットワークからの利用 ローカルネットワーク内にLLM実行PCが有ると利用PCからアクセスしてLM実行PC上でモデルを実行して答えを得られます。ここでは、LM Link設定で登録した同一アカウントでの利用方法を記載します。[接続イメージ](https://book.a10-objects.jp/books/lm-studio/page/lm-link "概要")

2026年4月10日現在 LM Linkは現時点では、2ユーザーまで、各ユーザー5台まで、合計で10台無料で利用できます。追加のユーザー数やデバイス数に対する有料プランはまだ導入されていませんが、LM LinkがPreview期間を終了した後に提供される予定のようです。

[LM Link WebSite](https://lmstudio.ai/link) LM Link is free to use for up to 2 users, 5 devices each (10 devices total). We have not yet introduced a way to pay for additional users or devices, but expect to add that once LM Link moves out of Preview.

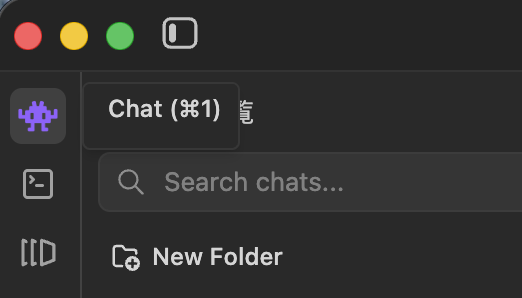

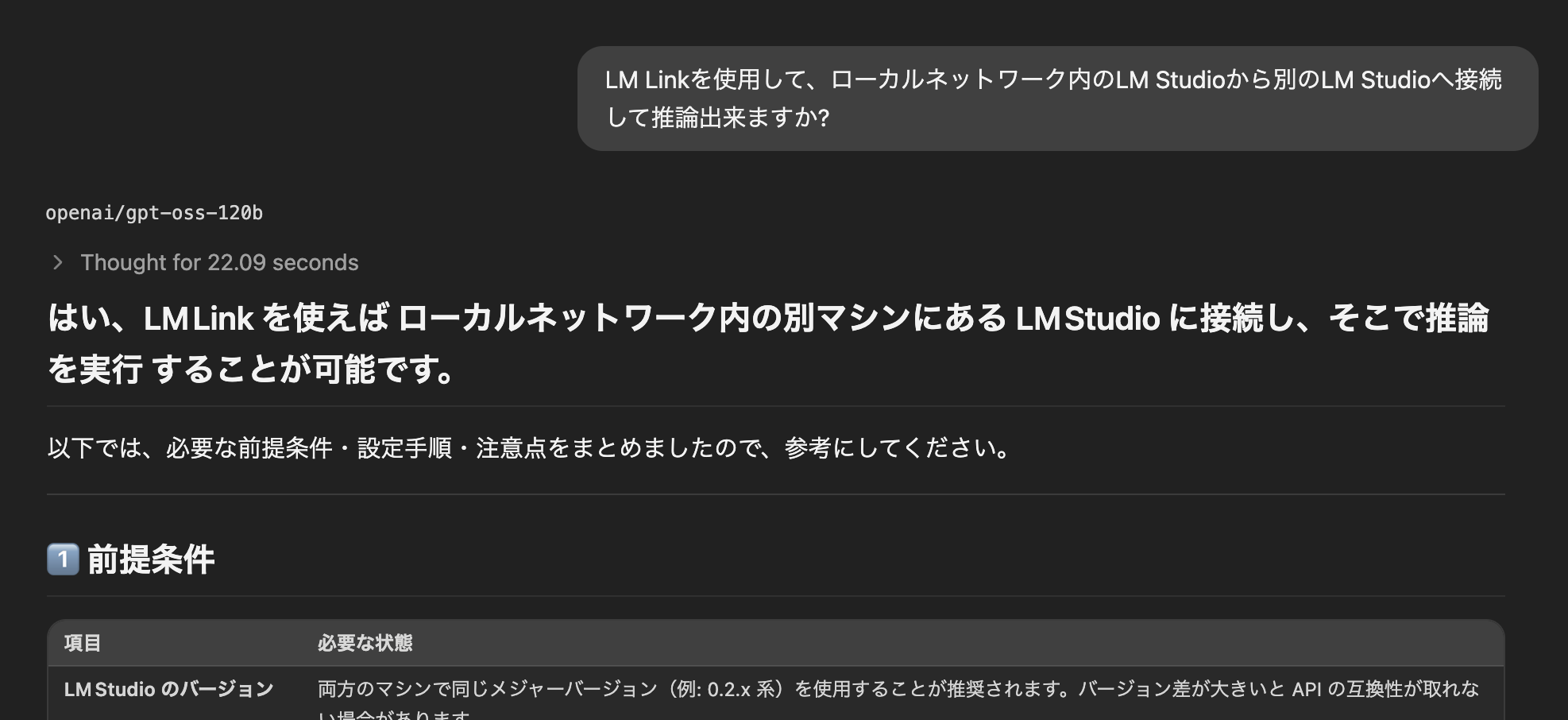

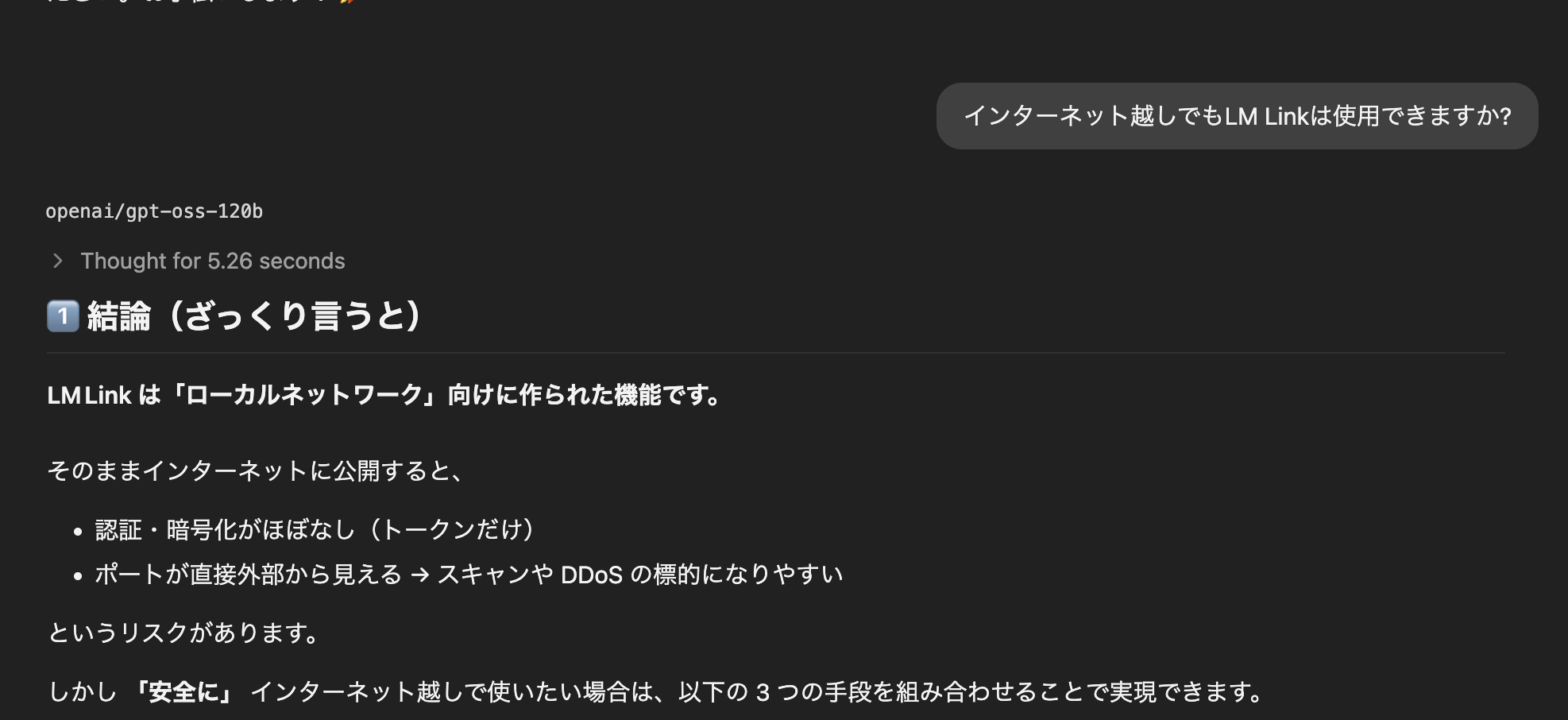

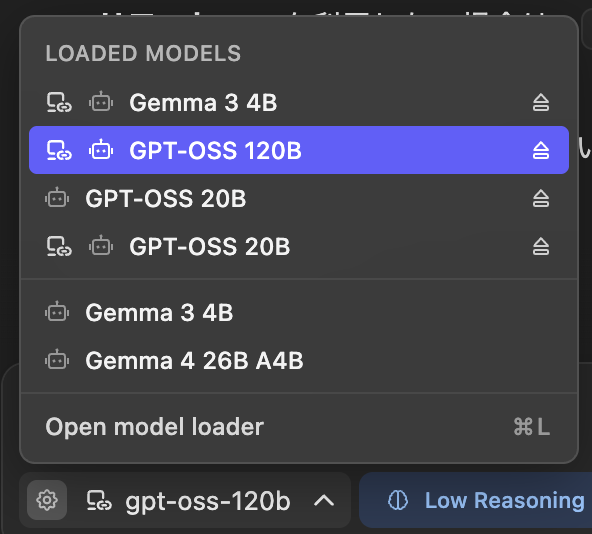

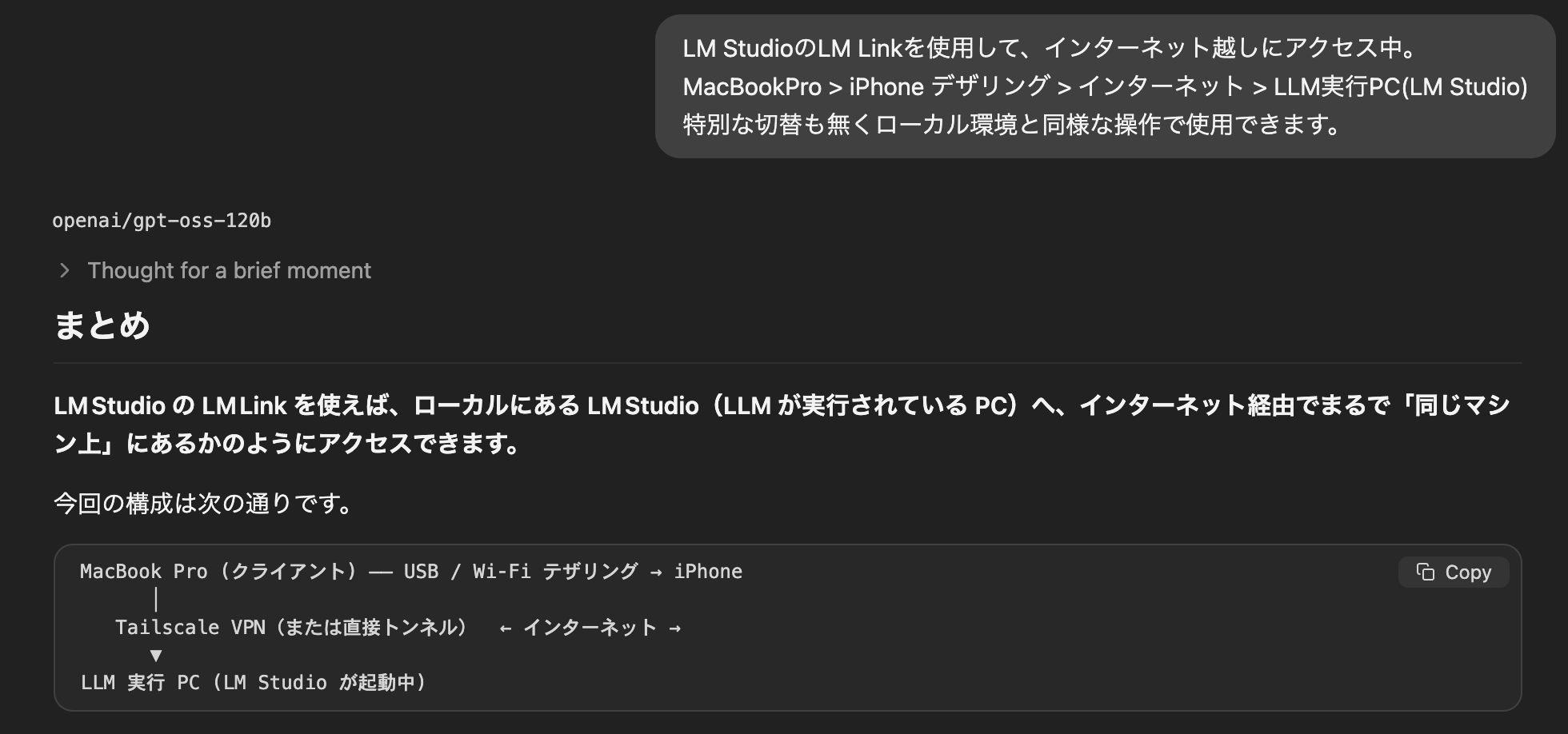

##### LM Linkに登録確認 LM Studio Hubで登録されているデバイスを確認します。1ユーザー当たり最大5台なので画面からは2台登録されています。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-0-26-37.jpg) ##### LLM実行PCへアクセス 利用PCからアクセスしてみます。 「LM Studio」アプリの左上から「Chat」を選択します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-0-32-10.png) 次にメッセージ入力枠から使用するモデルを選択します。この時、LLM実行PC上のモデルも見えていると思います。ここでは「GPT-OSS 120B」を選択します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-0-33-45.png) [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/IKX2026-04-10-0-34-06.png) これでLLM実行PC上のモデルが利用できる様になります。試しにメッセージを送ってみましょう。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-0-37-40.png) [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-0-37-56.png) もう一つ、質問してみました。LM Linkは新しいサービスなので、選択したモデルでは無理と答えています。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-0-40-07.png) # インターネットアクセス ##### インターネットアクセス LLM実行PCを社内のローカルネットワークに置き、利用PCは外からインターネット越しにLLM実行PCを利用することが出来ます。[接続イメージ](https://book.a10-objects.jp/books/lm-studio/page/lm-link "概要")

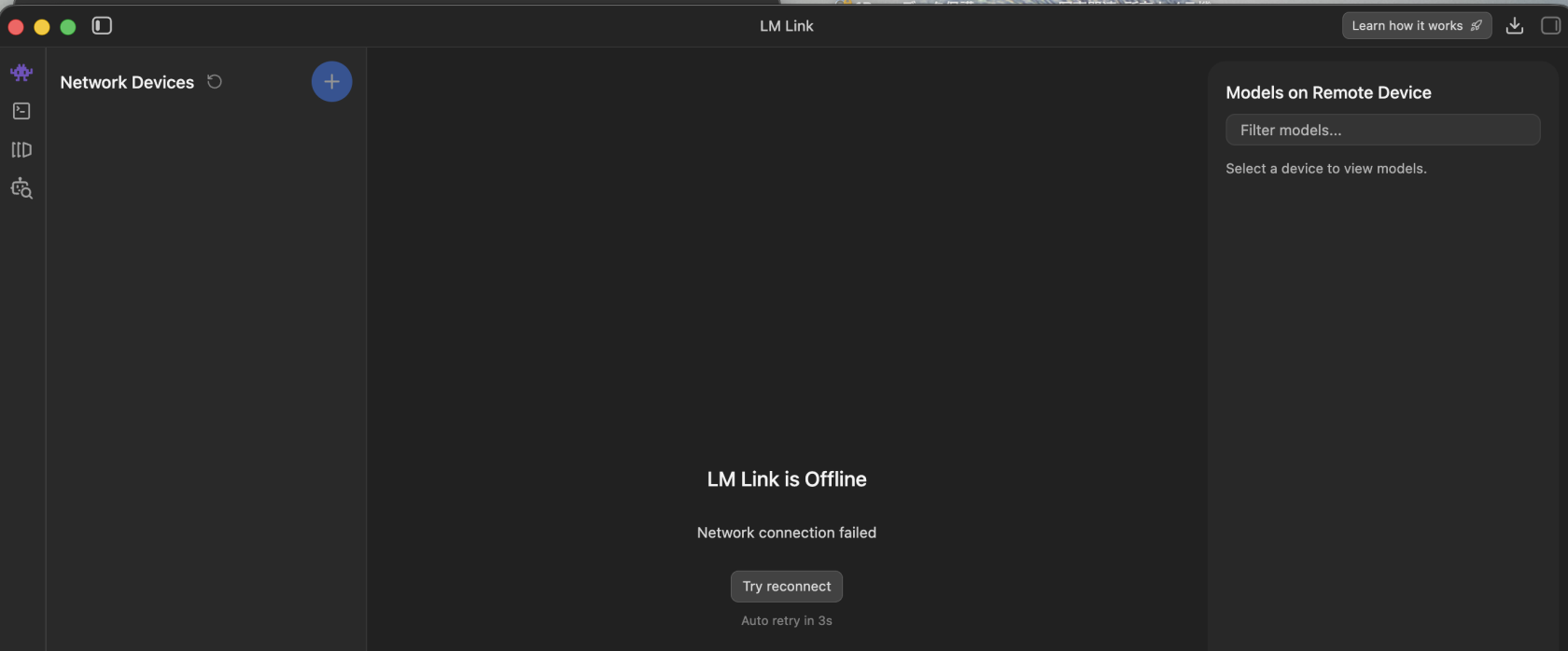

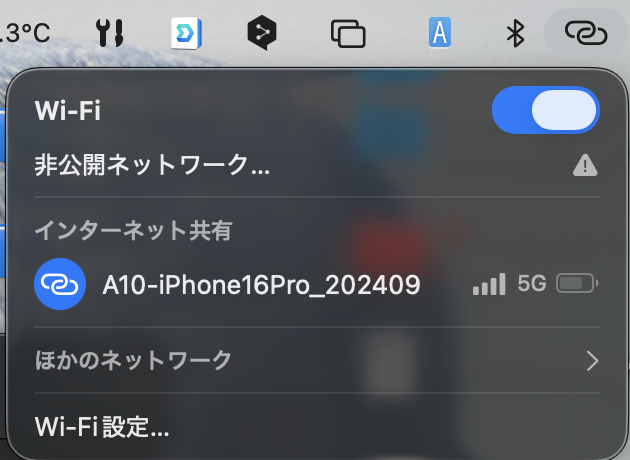

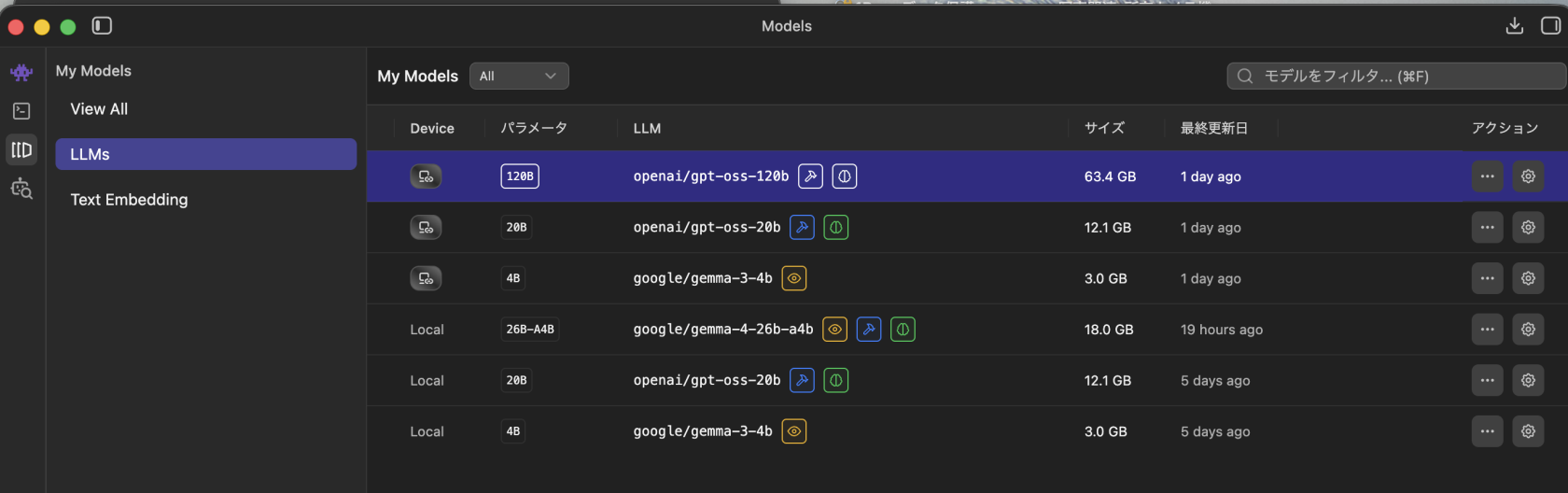

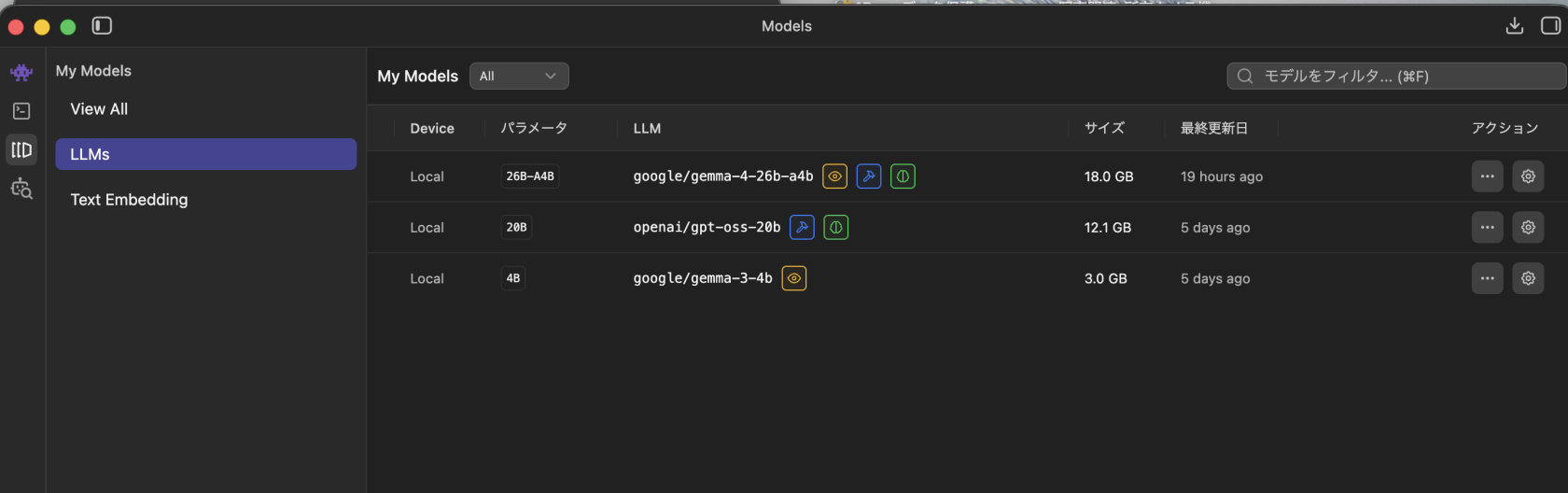

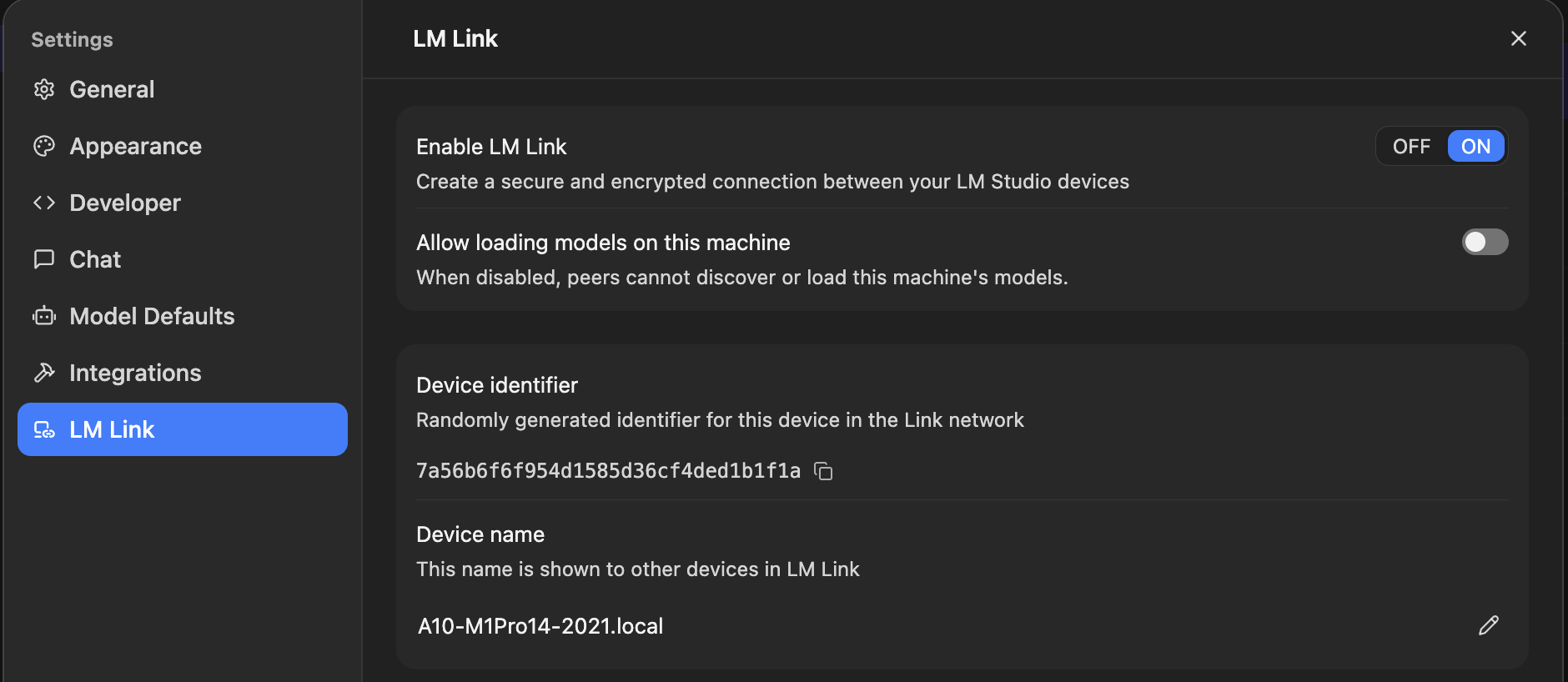

##### 具体例 具体的に実際にiPhoneのデザリングを使用して、外からLLM実行PCをアクセスした例を記述します。以下の説明は、利用PCからの操作などです。 利用PCの「LM Studio」起動してLLM実行PCとの接続を確認します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-1-17-48.png) 接続されているPCは有りません。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/pwFimage.png) 次にMacBookProをiPhoneとデザリングでインターネットに接続します。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-1-17-20.png) 「LM Studio」アプリは10秒間隔で接続を試みるようで、ネットワークに接続すると自動的にLLM実行PCに接続出来ました。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-1-27-21.png) Chat画面に戻って、LLM実行PCのモデルを選択して質問をしてみましょう。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-1-18-45.png) [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-1-21-37.png) インターネット越しでもローカルネットでも特別な操作無しで「LM Studio」が使用できました。 ##### モデルの状態 参考にLLM実行PCへ接続したときと未接続時のモデル一覧です。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-1-25-54.png) [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-10-1-26-20.png) # モデルを非公開設定 ##### 非公開設定 「LM Studio」アプリがローカルで使用しているモデルはLM Linkを有効にすると、LM Link対象になっているPCですべて使用できるようになります。 「LM Studio」アプリが自身のローカルモデルを非公開にするには非公開にしたいPCかーの設定を変更します。「Settings > LM Link」の「**Allow loading models on this machine**」をOFFにします。モデル一覧以外は非公開にはならないよ! 使用しているLM Linkはベータなので今後のアップデータを期待しましょう。 2026年4月11日

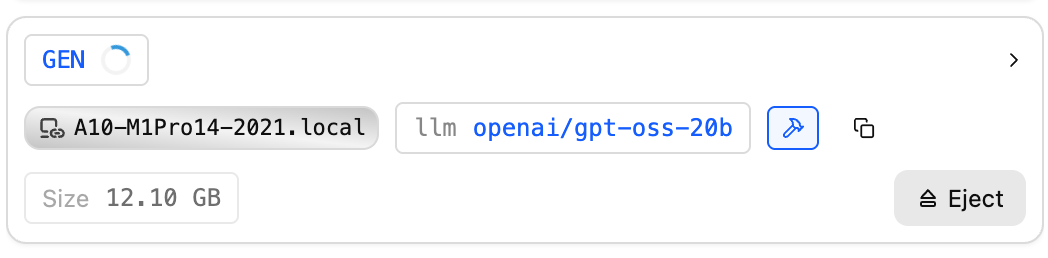

[](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-11-4-15-53.png) OFFにするとML Linに接続される「「LM Studio」アプリのモデル一覧から除かれます。 ##### 非公開/公開のモデル一覧 ON時のモデル一覧の例です。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-11-4-22-34.png) OFF時のモデル一覧の例です。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-11-4-16-30.png) ##### モデルを非行にしても表示? モデルを非公開にしているのですが、何故か「Developer」画面とチャット画面では表示されます。バグ?

[](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-11-5-01-00.png) [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-11-4-42-55.png) モデルは常に使用可能非公開設定してもモデル一覧に出ないだけで、Developer画面とかチャット画面では使用できます。おそらくバグ?ですかね。現在ベータ版です。2026年4月11日

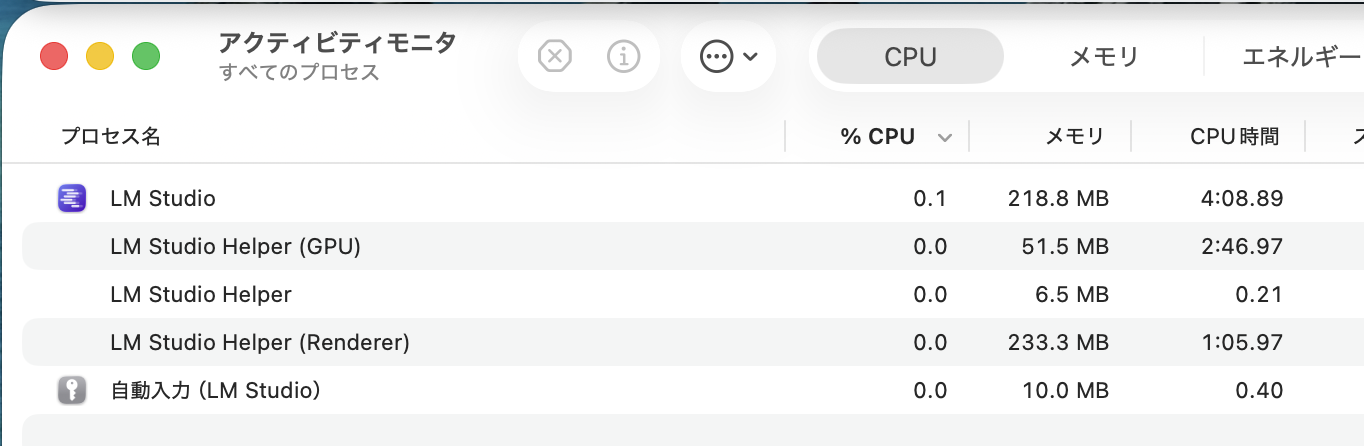

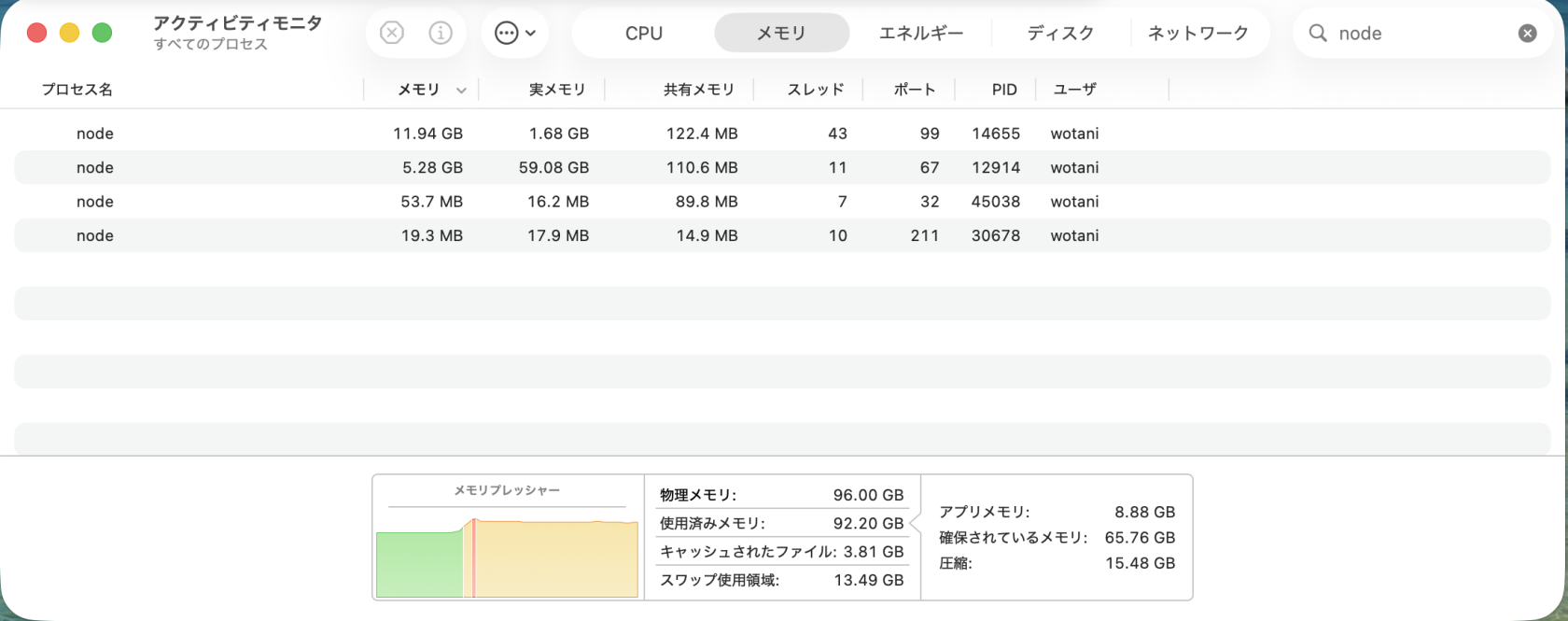

# モデルのメモリ使用量 ##### モデルのメモリ使用量 「LM Studio」関係のモデル用のタスク「node」のメモリ使用量です。未だ短期間のテストなので詳しく分からないところが多々あります。

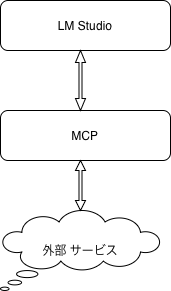

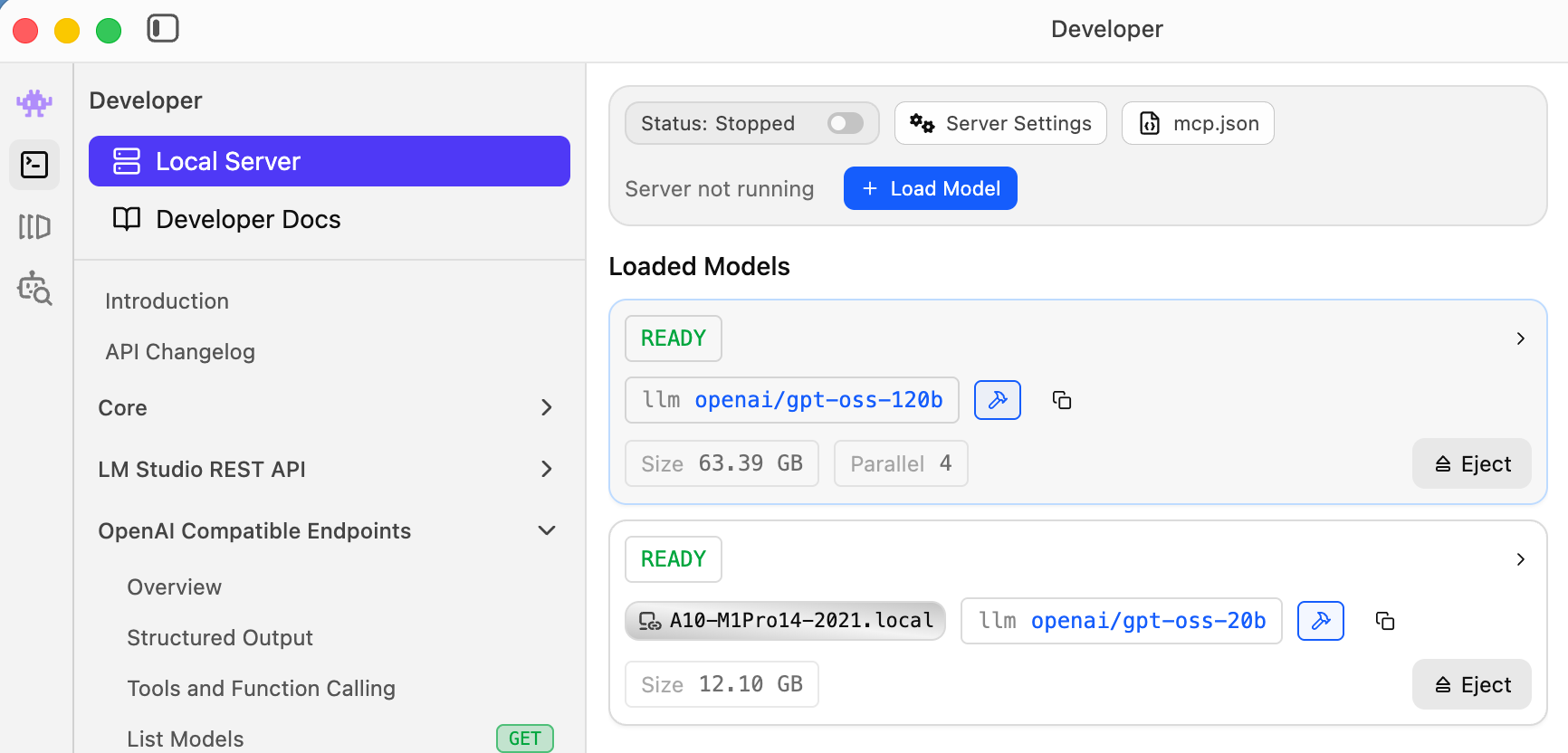

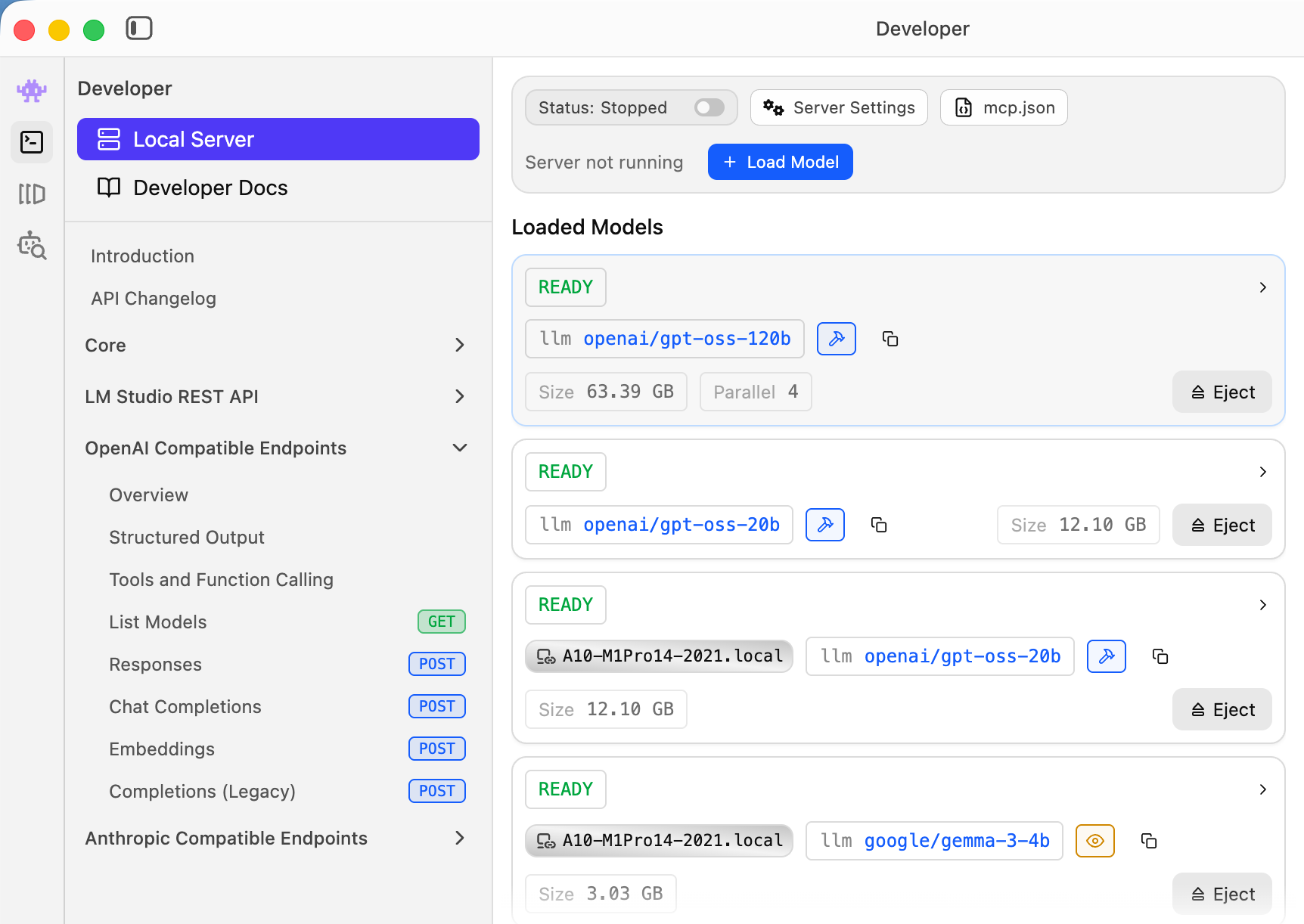

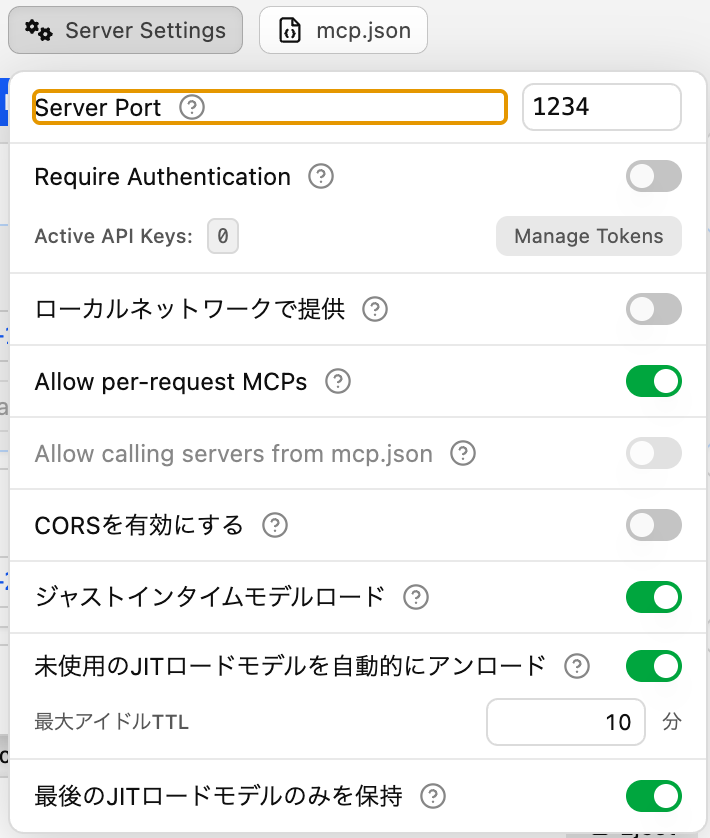

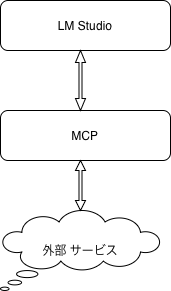

モデル「openai/gpt-oss-120b」をロードしているので60GB程度の実メモリを使用して。システム全体では92GBも使用しています。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-11-5-05-32.png) ##### モデルのロード状態 Developer画面のLocal Serverから現在のモデルのロード状態の詳細を確認出来ます。先のアクティビティモニタでは4つ有りますが、2つが自身が指定してロードしたモデルのプロセスです。他の2つは不明です(未調査)。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-11-5-05-37.png) ここで「Server Settings」を確認します。 「未使用のJITロードモデルを自動的にアンロード」がONとなって、10分を指定してます。しかし、10分を経過してもアンロードされません。LM Link動作時にアンロードされるとプロセスが終了してメモリ使用が無くなると推測していたのですが。。。設定方法が間違っているのか?現在の所はモデルがアンロードされてメモリが実行されない原因は不明です。また、API使用時だけの機能なのかは未確認です。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-11-5-06-03.png) 「LM Studio」アプリを終了 モデル用のプロセス「node」はアプリが終了しても残ります。LM Link機能かの兼ね合いで残る必要が有るのかも。試しにLM LinkをOFFにしましたが特に変化は有りませんでした。 ##### メモリを解放 自動的に解放されないので、マニュアルで解放します。「Eject」ボタンを押してモデルを解放します。今回は「openai/gpt-oss-120b」を解放してみました。他のユーザーが使用中でも他のるPC全てからモデルを解放出来るので「Eject」ボタンの使用は注意する必要が有ります。途中で「Eject」されると当然ですが、中途半端に止まります。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-11-5-28-25.png) [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-11-5-30-06.png) キャッシュ上には残っている様ですが、使用済みメモリは「92GBから32GB 」と大幅に少なくなりました。アプリの改良を待ちたいと思います。それまでは、手作業でモデルのメモリ使用量を管理しましょう。 # 外部サービス連携(MCP) 「LM Studioのテスト」関係のRemote MCPを導入する記事です。「LM Studio」に簡単に機能を追加出来ます。 # MCPの設定 ##### 概要 MCP(Model Context Protocol )はAIツール(今回は「LM Studio」)が外部へアクセスするために作られた共通の接続方式をです。例えば、Webの検索、外部データを扱うなどです。 「LM Studio」では次の様な構造となります。他のAIツールでも同等な構成となると思います。

注意: ここで「Edit mac.json」もしくは「Configure」ボタンを押さないでください。「LM Stduio」アプリおよび設定が壊れてチャットウインドウからモデルの操作ができなくなります。単純な回復は未調査なので、今回は設定ファイル関係(この時点で全ての履歴とモデルは無くなり、新しく導入したと同等)の削除と「LM Stduio」アプリの再インストールがで対応しました。2026-04-13 バージョン0.4.11+1 (0.4.11+1)で発生しました。 他のバージョンでこの現象が発生するかは確認していません。

チャットウインドウの左が次の表示の様になり、モデルの切り替えなどが出来なくなります。

[](https://book.a10-objects.jp/uploads/images/gallery/2026-04/3pL2026-04-13-5-59-52.png)

正しいチャットウインドウの例です。モデル名などが表示されています。[](https://book.a10-objects.jp/uploads/images/gallery/2026-04/xiM2026-04-13-6-01-47.png)

注意: この方法は殆ど全ての情報を無くします。

##### アプリと関連プロセスの終了 「LM Studio」アプリと関連プロセスを完全に終了します。「LM Studio」アプリを終了してもプロセス名「LM (半角スペース)」から始まるプロセスを確認して「LM Studio」を強制終了します。また、「node」という関連プロセス名が有ります。「node」といういプロセス名は他のアプリで同一のプロセス名を割り当てられている事が有るので注意してください。プロセスの上位プロセス名が「LM Studio」のみを終了してください。 通常「LM Studio」アプリを終了すると関連プロセスも自動的に終了(最初にモデルをアンロードするのがコツ)します。終了されない場合にはプロセス名「LM Studio」アプリを強制終了すると終了します。 今回、確認した「LM Studio」バージョンは「バージョン0.4.11+1 (0.4.11+1)」です。 ##### 設定ファイルなどの削除 次に不可視フォルダを内容込みで全て削除します。このファイルには履歴とかアプリの設定、モデルファイルなどのほぼ全ての情報が入っています。もし必要なら「.lmstudio.bk」の様に名前を変更して保存して下さい。 ~/.lmstudio ##### アプリの再インストール 「LM Studio」アプリをサイトからダウンロードして、置き換えてください。 アプリを起動して、新しいアプリとして、再設定してください。 ここまでで、多くの「LM Studio」情報が初期化され、新しいアプリとして使用できるようになります。MCPが起動して検索作業中に実行の有無を尋ねる場合有ります。[](https://book.a10-objects.jp/uploads/images/gallery/2026-04/GY39PX7yDB.jpg)

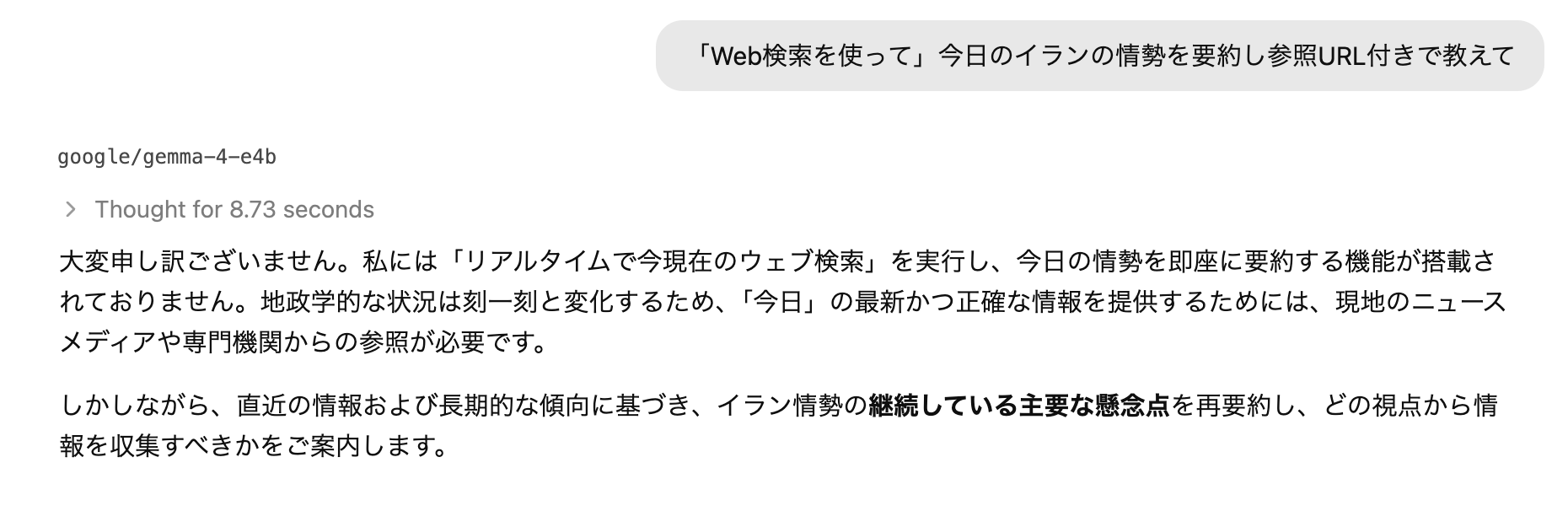

試しに、MCPをOFFにして同様な質問をしてみました。結果は次の通りです。レスポンスとして『「リアルタイムで今現在のウェブ検索」を実行し、今日の情勢を即座に要約する機能が搭載されておりません。』と明言しています。当然、MCPが動作していると思われる表示は有りませんでした。 [](https://book.a10-objects.jp/uploads/images/gallery/2026-04/2026-04-13-11-43-50.png)